Kjo temë është një nga ato qendrore në teorinë e informacionit. Ai merr në konsideratë aftësitë kufizuese të kanaleve të komunikimit për transmetimin e informacionit, përcakton karakteristikat e kanaleve që ndikojnë në këto aftësi, eksploron në formën më të përgjithshme aftësitë kufizuese të kodimit që ofrojnë imunitet maksimal ndaj zhurmës dhe sasinë e informacionit të transmetuar.

Përkufizimet:

1. Shkalla e transferimit të informacionitështë sasia mesatare e informacionit të transmetuar përmes kanalit për njësi të kohës.

Në rastin e një kanali pa zhurmë, kjo shpejtësi është e barabartë me V në *H në, ku V teështë numri i simboleve të transmetuara përmes kanalit për njësi të kohës, H teështë entropia mesatare e një simboli mesazhi në hyrje dhe dalje të kanalit.

2. Performanca e burimitështë shkalla mesatare e marrjes së informacionit nga burimi i mesazhit.

Performanca e burimit gjendet nga formula V dhe *H dhe, ku V dheështë numri i simboleve të gjeneruara nga burimi për njësi të kohës, H dheështë entropia mesatare e një simboli të mesazhit në daljen e burimit.

Kapaciteti i kanalit të komunikimit- shpejtësia maksimale e mundshme e transferimit të informacionit për këtë kanal. Ne do ta shënojmë atë C te.

Vëmë re një tjetër karakteristikë të rëndësishme të kanalit - shkallën maksimale të simbolit V deri në maksimum nëpërmjet tij. Ajo është gjithmonë e kufizuar. Prandaj, shpejtësia maksimale e transferimit të informacionit arrihet duke përdorur shpejtësinë maksimale të simbolit dhe entropinë maksimale mesatare V deri në maksimum karakteri i transmetuar. Më parë, u vërtetua se entropia mesatare maksimale për një simbol arrihet me probabilitet dhe pavarësi të barabartë të shfaqjes së tyre.

Meqenëse burimi i informacionit nuk prodhon domosdoshmërisht simbole me këto karakteristika, ato duhet të kodohen për të arritur përdorimin më efikas të kanalit. Më parë, gjatë studimit të kodimit efikas, u vërtetua se është kodim efikas që siguron, pas kodimit, karaktere me parametrat e kërkuar. Entropia e simboleve të alfabetit dytësor si rezultat i një kodimi të tillë kur kodohen blloqe pafundësisht të mëdha të sekuencës së informacionit në kufi është e barabartë me trung 2m, ku mështë vëllimi i alfabetit dytësor që përdoret në daljen e koduesit.

Duke pasur parasysh këtë: C në \u003d V në * H max \u003d V në * log 2 m.

Nëse m=2(për kodim përdoret kodi binar), atëherë entropia e një karakteri në daljen e koduesit do të jetë e barabartë me 1, d.m.th. çdo simbol i kodit binar efektiv do të ketë 1 bit informacion dhe vetë simbolet do të jenë po aq të mundshëm dhe statistikisht të pavarur.

Në këtë rast C në \u003d V në.

Kur transmetojnë informacion përmes një kanali komunikimi, ata përpiqen për përdorimin më efikas (për sa i përket sasisë së informacionit të transmetuar) të tij.

Le të gjejmë kërkesat për burimin e informacionit, sipas të cilave shpejtësia maksimale e transmetimit të informacionit përmes kanalit është e mundur.

Ne do të përshkruajmë burimin e informacionit me parametra V dhe dhe H dhe. Supozoni se nuk ka zhurmë në kanalin e komunikimit. Kanali i komunikimit përshkruhet nga gjerësia e brezit dhe vëllimi i tij m alfabeti.

Meqenëse nuk ka zhurmë në kanal, informacioni nuk shtrembërohet ose humbet gjatë transmetimit përmes tij. Prandaj, shkalla e transferimit të informacionit në daljen e burimit V dhe *H dhe dhe dalja e kanalit do të përputhet. Përdorimi më efikas i kanalit do të jetë i tillë që performanca e burimit do të jetë e barabartë me gjerësinë e brezit të kanalit:

C deri në \u003d V deri në maksimum * log 2 m \u003d V dhe * H dhe.

Kështu, nëse dihet entropia mesatare e një simboli të një mesazhi që vjen nga dalja e burimit, përdorimi më efikas i kanalit mund të arrihet nëse shkalla e mbërritjes së këtyre simboleve nga burimi zgjidhet në përputhje me formulën. : V dhe \u003d V deri në maksimum * log 2 m / H dhe ose V dhe \u003d V në maksimum / H dhe duke përdorur kodimin binar më të përdorur.

Vini re se kjo formulë supozon përdorimin e kodimit efikas të informacionit që vjen nga burimi përpara se ta transferojë atë në kanalin e komunikimit pa ndërhyrje (zhurmë).

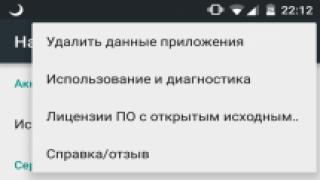

Merrni parasysh modelin e mëposhtëm të një kanali komunikimi të zhurmshëm (Fig. 4.4):

Oriz. 4.4. Modeli i kanalit të komunikimit me zhurmë.

Sipas llojit të sinjaleve të transmetuara përmes kanalit, dallohen kanalet e komunikimit diskrete dhe të vazhdueshme.

Karakteristika më e rëndësishme e një kanali është e tij gjerësia e brezit, e përcaktuar si shkalla më e lartë e transferimit të informacionit përmes tij. Gjerësia e brezit të një kanali diskret mund të llogaritet, për shembull, duke përdorur formulën e mëposhtme:

C \u003d V k * I m a x ,

ku Vk– shpejtësia e transmetimit të karaktereve alfabetike përmes kanalit;

Unë jam një x– sasia maksimale e mundshme e informacionit për një simbol të transmetuar përmes kanalit.

Sasia e informacionit për 1 simbol të transmetuar përmes kanalit varet nga entropia (shkalla e pasigurisë në marrjen e simbolit) në hyrje dhe dalje të kanalit. Sipas masës Shannon

I = H a priori - H e pasme = H(X) – H(X/Y) .

Këtu H a priori = H(X) dhe H e pasme = H(X/Y)– entropia e kushtëzuar që karakterizon pasigurinë rreth simbolit të transmetuar në daljen e kanalit X sipas simbolit të pranuar Y në dalje. Prania e kësaj pasigurie është pasojë e veprimit në simbolin e zhurmës që transmetohet përmes kanalit. H(X/Y) - karakteristikë e kanalit.

Fundi i punës -

Kjo temë i përket:

Teoria e informacionit dhe kodimit

Universiteti Shtetëror i Soçit.. Turizëm dhe Biznes turistik.. Fakulteti i Teknologjisë së Informacionit dhe Matematikës..

Nëse keni nevojë për materiale shtesë për këtë temë, ose nuk keni gjetur atë që po kërkoni, ju rekomandojmë të përdorni kërkimin në bazën e të dhënave tona të veprave:

Çfarë do të bëjmë me materialin e marrë:

Nëse ky material doli të jetë i dobishëm për ju, mund ta ruani në faqen tuaj në rrjetet sociale:

| cicëroj |

Të gjitha temat në këtë seksion:

Kursi leksioni

Organizimi efektiv i shkëmbimit të informacionit po bëhet gjithnjë e më i rëndësishëm si kusht për aktivitetet praktike të suksesshme të njerëzve. Sasia e informacionit të nevojshëm për funksionimin normal të modernes

Përkufizimi i konceptit të informacionit

Fjala informacion vjen nga latinishtja informare - për të përshkruar, për të hartuar një koncept për diçka, për të informuar. Informacioni së bashku me lëndën dhe energjinë është parësor

Fazat e qarkullimit të informacionit

Sistemi i kontrollit përbëhet nga një objekt kontrolli, një kompleks mjetesh teknike të përbërë nga një kompjuter, pajisje hyrëse-dalëse dhe ruajtëse informacioni të përfshira në të, pajisje për mbledhjen e transmetimit.

Disa përkufizime

Të dhënat ose sinjalet e organizuara në sekuenca të caktuara mbartin informacion jo sepse përsërisin objekte të botës reale, por sipas konventës shoqërore për kodimin, d.m.th. një

Masat e Informacionit

Përpara se të kalojmë në masat e informacionit, theksojmë se burimet e informacionit dhe mesazhet që ato krijojnë ndahen në diskrete dhe të vazhdueshme. Mesazhet diskrete përbëhen nga fundi

masë gjeometrike

Përcaktimi i sasisë së informacionit me metodën gjeometrike reduktohet në matjen e gjatësisë së vijës, sipërfaqes ose vëllimit të modelit gjeometrik të një bartësi ose mesazhi të caktuar informacioni. Sipas dimensioneve gjeometrike

Masa shtesë (masa Hartley)

Masa shtesë mund të konsiderohet si një masë kombinuese më e përshtatshme për një numër aplikimesh. Intuitat tona rreth informacionit sugjerojnë se sasia e informacionit rritet me

Entropia dhe vetitë e saj

Ekzistojnë disa lloje të matjeve statistikore të informacionit. Në vijim do të shqyrtojmë vetëm njërën prej tyre, masën Shannon. Matja Shannon e sasisë së informacionit është e lidhur ngushtë me konceptin

Entropia dhe entropia mesatare e një ngjarjeje të thjeshtë

Le të shqyrtojmë më në detaje konceptin e entropisë në versione të ndryshme, pasi përdoret në teorinë e informacionit të Shannon. Entropia është një masë e pasigurisë së disa përvojave. Në rastin më të thjeshtë, ajo

Metoda e shumëzuesit të Lagranzhit Nxjerrja e formulës për vlerën mesatare të entropisë për shkronjë mesazhi Entropia e një ngjarje komplekse të përbërë nga disa ngjarje të varura Tepricë e mesazheve Përmbajtja e informacionit Dobia e informacionit Entropia dinamike Entropia e mesazheve të vazhdueshme Rasti i parë (vlerat e sasive të mëposhtme janë të kufizuara nga intervali) Rasti i dytë (varianca dhe pritshmëria matematikore e vlerës së radhës janë dhënë) Kuantizimi i sinjalit Llojet e diskretizimit (kuantizimi) Kriteret për saktësinë e paraqitjes së një sinjali të kuantizuar Elementet e teorisë së përgjithësuar spektrale të sinjaleve Mbi përdorimin praktik të teoremës së Kotelnikov Zgjedhja e periudhës së kampionimit (kuantizimi kohor) sipas kriterit të devijimit më të madh Interpolimi duke përdorur polinomet e Lagranzhit Vlerësimi i vlerës maksimale të gabimit në marrjen e funksionit të riprodhimit bazuar në polinomin e Lagranzhit Përgjithësim në rastin e përdorimit të polinomeve të Lagranzhit të rendit arbitrar Zgjedhja e intervalit të marrjes së mostrave sipas kriterit të devijimit standard Kuantizimi i nivelit optimal Llogaritja e optimales jouniforme në kuptimin e gabimit minimal të variancës së shkallës së kuantizimit Koncepte dhe përkufizime të përgjithshme. Qëllimet e kodimit Elementet e teorisë së kodimit Pabarazia e Kraft Teorema 2. Teorema 3. Teorema mbi gjatësinë minimale mesatare të një fjale kodi për kodimin e bllokut (Teorema 4) Kodet optimale jo uniforme Lema 1. Mbi ekzistencën e një kodi optimal me të njëjtën gjatësi fjalësh kodi me dy shkronja të koduara më pak të mundshme Lema 2. Mbi optimalitetin e kodit të parashtesës së një ansambli jo të reduktuar nëse kodi parashtesor i ansamblit të reduktuar është optimal

Karakteristikat e kodeve efikase Kodimi për korrigjimin e zhurmës Modelet më të thjeshta të kanaleve të komunikimit dixhital me ndërhyrje Llogaritja e probabilitetit të shtrembërimit të një fjale kodi në DSMK Parimet e përgjithshme për përdorimin e tepricës Kufiri i Hamingut Tepricë e kodeve korrigjuese të gabimeve Kodet e linjave Përcaktimi i numrit të shifrave shtesë m Ndërtimi i një matrice gjeneruese Rendi i kodimit Rendi i dekodimit Kodet ciklike binare Disa veti të kodeve ciklike Ndërtimi i një kodi me një aftësi të caktuar korrigjuese Përshkrimi i matricës së kodeve ciklike Zgjedhja e një polinomi gjenerues Llojet e kanaleve të transmetimit të informacionit Gjerësia e brezit të një kanali komunikimi diskret me zhurmë Sekuencat tipike dhe vetitë e tyre Teorema kryesore e Shannon-it për një kanal diskrete me zhurmë Diskutimi i teoremës kryesore të Shannon-it për një kanal të zhurmshëm Përçueshmëria e një kanali të vazhdueshëm në prani të zhurmës shtesë Hapi 2. Futja e skedarëve të tekstit në një spreadsheet Excel, duke thyer çdo rresht teksti në karaktere të veçanta Hapi 4. Gjeni entropinë mesatare për 1 shkronjë të mesazhit Hapi 8. Le të shkruajmë një raport progresi që përshkruan të gjitha llogaritjet dhe mënyrën se si janë kryer ato. Komentoni rezultatet Lidhja e mundësisë së përdorimit të funksioneve jo standarde Krijimi i një funksioni të personalizuar Regjistrimi i zërit dhe përgatitja e sinjalit Importoni të dhëna teksti në Excel Kuantizimi i nivelit reduktohet në zëvendësimin e vlerës së sinjalit origjinal me nivelin e hapit brenda të cilit bie kjo vlerë Kodet Huffman Procesi përsëritet derisa të mbetet vetëm një shkronjë në secilin nëngrup. Parametrat e efikasitetit të kodeve optimale Karakteristikat e kodeve efikase Përfundimi i punës Ndërtimi i një matrice gjeneruese Rendi i kodimit Rendi i dekodimit Përfundimi i punës Në çdo sistem komunikimi, informacioni transmetohet përmes një kanali. Shkalla e transferimit të informacionit është përcaktuar në § 2.9. Kjo shpejtësi varet jo vetëm nga vetë kanali, por edhe nga vetitë e sinjalit të aplikuar në hyrjen e tij dhe për këtë arsye nuk mund ta karakterizojë kanalin si një mjet për transmetimin e informacionit. Le të përpiqemi të gjejmë një mënyrë për të vlerësuar aftësinë e kanalit për të transmetuar informacion. Le të shqyrtojmë fillimisht një kanal diskret përmes të cilit simbolet nga alfabeti transmetohen për njësi të kohës.Gjatë transmetimit të secilit simbol, sasia mesatare e informacionit kalon nëpër kanal [shih Fig. (2.135) dhe (2.140)]: ku janë simbolet e rastësishme në hyrje dhe dalje të kanalit. Nga katër entropitë që shfaqen këtu, informacioni i qenësishëm i simbolit të transmetuar përcaktohet nga burimi i sinjalit diskret dhe nuk varet nga vetitë e kanalit. Tre entropitë e mbetura në përgjithësi varen si nga burimi i sinjalit ashtu edhe nga kanali. Le të imagjinojmë që simbolet nga burime të ndryshme të karakterizuara nga shpërndarje të ndryshme probabiliteti mund të futen në hyrjen e kanalit (por, natyrisht, për të njëjtat vlera. Për secilin burim të tillë, sasia e informacionit të transmetuar në kanal merr vlerën e vet. sasia maksimale e informacionit të transmetuar, marrë nga të gjitha llojet e burimet e sinjalit hyrës, karakterizon vetë kanalin dhe quhet gjerësia e brezit të kanalit. për personazh ku maksimizimi kryhet mbi të gjitha shpërndarjet e probabilitetit me shumë variacione. Ju gjithashtu mund të përcaktoni xhiron e kanalit C për njësi të kohës (sekondë): Barazia e fundit rrjedh nga aditiviteti i entropisë. Në të ardhmen, kudo që nuk është thënë në mënyrë specifike, ne do ta kuptojmë xhiros për sekondë si xhiro. Si shembull, ne llogarisim kapacitetin e një kanali simetrik pa memorie për të cilin probabilitetet e tranzicionit janë dhënë me formulën (3.36). Sipas (3.52) dhe (3.53) Vlera në këtë rast llogaritet lehtësisht, pasi probabiliteti i tranzicionit të kushtëzuar merr vetëm dy vlera: nëse e para nga këto vlera ndodh me probabilitet dhe e dyta me probabilitet K. Gjithashtu, duke qenë se konsiderohet një kanal pa kujtesë, rezultatet e marrjes simbolet individuale janë të pavarura nga njëra-tjetra. Kjo është arsyeja pse Prandaj, nuk varet nga shpërndarja e probabilitetit B, por përcaktohet vetëm nga probabilitetet e tranzicionit të kanalit. Kjo veçori ruhet për të gjitha modelet e kanaleve me zhurmë shtesë. Duke zëvendësuar (3.56) në (3.55), marrim Meqenëse në anën e djathtë vetëm termi varet nga shpërndarja e probabilitetit, është e nevojshme ta maksimizoni atë. Vlera maksimale sipas (2.123) është e barabartë dhe realizohet kur të gjitha simbolet e marra janë njësoj të mundshme dhe të pavarura nga njëri-tjetri. Është e lehtë të verifikohet se ky kusht është i plotësuar nëse simbolet hyrëse janë njësoj të mundshme dhe të pavarura, pasi Në të njëjtën kohë dhe Prandaj xhiroja për sekondë Për një kanal simetrik binar, qarkullimi në njësi binare për sekondë Varësia nga sipas (3.59) është paraqitur në fig. 3.9. Kur është kapaciteti i një kanali binar, pasi me një probabilitet të tillë gabimi mund të merret një sekuencë e simboleve binare dalëse pa transmetuar fare sinjale mbi kanal, por duke i zgjedhur ato në mënyrë të rastësishme (për shembull, sipas rezultateve të hedhjes së një monedhë), d.m.th., kur sekuencat në dalje dhe hyrje të kanalit janë të pavarura. Rasti quhet ndërprerje kanali. Fakti që xhiroja për në në kanalin binar është e njëjtë me atë për (një kanal pa zhurmë) shpjegohet me faktin se për në është e mjaftueshme për të përmbysur të gjitha simbolet e daljes (d.m.th., zëvendësoni 0 me 1 dhe 1 me 0) në mënyrë që të rivendoset saktë sinjali i hyrjes. Oriz. 3.9. Varësia e xhiros së një kanali simetrik binar pa memorie nga probabiliteti i marrjes së gabuar të një simboli Rrjedha e një kanali të vazhdueshëm llogaritet në mënyrë të ngjashme. Le të ketë, për shembull, një brez të kufizuar të kanalit. Pastaj sinjalet në hyrje dhe në dalje të kanalit, sipas teoremës së Kotelnikov, përcaktohen nga mostrat e tyre të marra në intervale, dhe për rrjedhojë informacioni që kalon nëpër kanal për disa kohë. është e barabartë me shumën e sasive të informacionit të transmetuar për çdo kampion të tillë. Kapaciteti i kanalit për një mostër të tillë Këtu, variablat e rastësishëm janë seksionet kryq të proceseve në hyrje dhe dalje të kanalit, dhe maksimumi merret mbi të gjitha sinjalet hyrëse të pranueshme, pra mbi të gjitha shpërndarjet. Rrjedha C përcaktohet si shuma e vlerave Сots» të marra mbi të gjitha mostrat për sekondë. Në këtë rast, natyrisht, entropitë diferenciale në (3.60) duhet të llogariten duke marrë parasysh marrëdhëniet probabiliste midis leximeve. Le të llogarisim, për shembull, kapacitetin e një kanali të vazhdueshëm pa memorie me zhurmë shtesë të bardhë Gaussian që ka një gjerësi brezi nëse fuqia mesatare e sinjalit (shpërndarja nuk e kalon një vlerë të caktuar) Fuqia (varianca) e zhurmës në brez shënohet me mostrat e sinjaleve hyrëse dhe dalëse, si dhe zhurma janë të lidhura me barazinë dhe meqenëse ka një shpërndarje normale me pritshmëri matematikore zero, atëherë dendësia e probabilitetit të kushtëzuar në fikse dhe gjithashtu do të jetë normale - me pritje matematikore dhe variancë Le të gjejmë xhiros për mostër: Sipas (2.152), entropia diferenciale e shpërndarjes normale nuk varet nga pritshmëria matematikore dhe është e barabartë. Prandaj, për ta gjetur atë, duhet të gjeni një densitet të tillë të shpërndarjes në të cilën është maksimizuar nga (3.61), duke qenë se variabla të rastësishme të pavarura, kemi Kështu, varianca është fikse, siç është dhënë. Sipas (2.153), me një variancë fikse, entropia diferenciale maksimale sigurohet nga shpërndarja normale. Mund të shihet nga (3.61) se me një shpërndarje normale njëdimensionale, shpërndarja do të jetë gjithashtu normale dhe, për rrjedhojë, Duke iu kthyer xhiros C për sekondë, vërejmë se informacioni i transmetuar në disa mostra është maksimal kur mostrat e sinjalit janë të pavarura. Kjo mund të arrihet nëse sinjali zgjidhet në mënyrë që dendësia e tij spektrale të jetë uniforme në brez.Siç tregohet në mostrat e ndara sipas intervaleve, shumëfishat janë reciprokisht të pakorreluar, dhe për vlerat Gaussian, i pakorreluar do të thotë i pavarur. Prandaj, gjerësia e brezit C (për sekondë) mund të gjendet duke shtuar gjerësinë e brezit (3.63) për mostrat e pavarura: Realizohet nëse një proces Gaussian me një dendësi spektrale uniforme në brezin e frekuencës (zhurmë pothuajse e bardhë). Nga formula (3.64) mund të shihet se nëse fuqia e sinjalit nuk do të ishte e kufizuar, atëherë gjerësia e brezit do të ishte e pafundme. Gjerësia e brezit është zero nëse raporti sinjal-zhurmë në kanal është zero. Me një rritje të këtij raporti, xhiroja rritet pafundësisht, por ngadalë, për shkak të varësisë logaritmike. Lidhja (3.64) shpesh quhet formula e Shannon-it. Kjo formulë është e rëndësishme në teorinë e informacionit, pasi përcakton varësinë e xhiros së kanalit të vazhdueshëm të konsideruar nga karakteristikat e tij teknike si gjerësia e brezit dhe raporti sinjal-zhurmë. Formula e Shannon tregon mundësinë e shkëmbimit të gjerësisë së brezit për fuqinë e sinjalit dhe anasjelltas. Megjithatë, meqenëse C varet nga linearisht dhe sipas një ligji logaritmik, në përgjithësi nuk është praktike të kompensohet një reduktim i mundshëm i gjerësisë së brezit duke rritur fuqinë e sinjalit. Më efikas është shkëmbimi i kundërt i fuqisë së sinjalit për gjerësinë e brezit. Konsideroni kanalin e komunikimit të paraqitur në fig. 5-1. Një sinjal dërgohet në fundin e tij transmetues x(t), e cila hyn në hyrjen e marrësit në një zhurmë të shtrembëruar n(t) formë y(t)[L. 47, 53]. Le të prezantojmë konceptin e gjerësisë së brezit të kanalit të komunikimit. Gjerësia e brezit të kanalit të komunikimit përcaktohet si vlera maksimale e informacionit relativ të sinjalit të daljes në lidhje me hyrjen: ku I(x, y)- informacioni relativ i dhënë nga formula (7-8), dhe të gjitha sinjalet konsiderohen si ekuivalente diskrete (Fig. 7-1), në mënyrë që Ndonjëherë vlera ku N=2f c t 0. Nëse leximet janë të pavarura, atëherë V=I 1 (x, y). Është e qartë se me ndihmën e sasisë V gjerësia e brezit të kanalit të komunikimit mund të përcaktohet me formulë Për entropinë e zhurmës, mund të shkruajmë: Н(n)=2f c t 0 H 1 (n), Entropia e zhurmës për mostër për zhurmën normale. Formula të ngjashme mund të shkruhen për sinjale normale X dhe y. Formula (7-10) për njësinë e referencës mund të shkruhet si Kuptimi i këtij përkufizimi duhet të sqarohet. Vini re se maksimumi këtu merret mbi grupin e shpërndarjeve të probabilitetit të sinjaleve hyrëse me zhurmë konstante, e cila supozohet të jetë e dhënë. Në një rast të veçantë, ky grup shpërndarjesh mund të përbëhet nga një shpërndarje normale, siç supozohet shpesh. Nëse kapaciteti i njërit kanal komunikimi është më i madh se tjetri (С 1 >С 2) në kushtet e mbetura identike, atëherë fizikisht kjo do të thotë që në rastin e parë dendësia e përbashkët e shpërndarjes së probabilitetit të sinjaleve hyrëse dhe dalëse është më e madhe se në të dytën, meqenëse duke përdorur formulën (7-11) është e lehtë të shihet se xhiroja përcaktohet kryesisht nga vlera e densitetit të shpërndarjes së probabilitetit të përbashkët. Nëse informacioni relativ (ose entropia) i sinjalit të daljes në lidhje me hyrjen është më i madh, atëherë kanali ka një kapacitet më të madh. Është e qartë se nëse zhurma rritet, atëherë xhiroja zvogëlohet. Nëse lidhja probabilistike ndërmjet sinjaleve dalëse dhe hyrëse zhduket, atëherë p(x,y)=p(x)p(y) dhe në formulën (7-11), logaritmi dhe rrjedhimisht xhiroja bëhen zero. Një rast tjetër kur p(x,y)=p(x|y)p(y) priret në zero, kërkon shqyrtim të hollësishëm, pasi regjistri p(x, y) priret në - ∞. Nese nje p(y) → 0, atëherë Arsyetimi mund të vazhdojë si më poshtë. Meqenëse probabiliteti i shfaqjes së sinjalit të daljes tenton në zero, mund të supozojmë se probabiliteti i shfaqjes së sinjalit X nuk varet nga y, d.m.th. p(x|y)=p(x) Në këtë rast, xhiroja është zero, e cila është në përputhje me interpretimin fizik, d.m.th., nëse nuk ka sinjal [as të dobishëm x(t), pa zhurmë n(t)], që do të thotë se ka një "prizë" (ndërprerje) në kanal. Në të gjitha rastet e tjera, xhiroja është jo zero. Është e natyrshme të përcaktohet gjerësia e brezit të kanalit të komunikimit në mënyrë që të mos varet nga sinjali hyrës. Për këtë, prezantohet një operacion maksimizimi, i cili, në përputhje me vetitë ekstreme të entropisë, më së shpeshti përcakton një sinjal hyrës me një ligj të shpërndarjes normale. Le të tregojmë se nëse x(t) dhe n(t) të pavarur dhe y(t)=x(t)+n(t), pastaj I(x,y)=H(y)-H(n), (7-12) ku H(y) dhe H(n) janë entropitë diferenciale të sinjalit të marrë dhe zhurmës. Kushti (7-12) nënkupton linearitetin e kanalit të komunikimit në kuptimin që zhurma thjesht i shtohet sinjalit si term. Ajo rrjedh drejtpërdrejt nga I(x,y)=H(x)-H(x|y)=H(y)-H(y|x). Sepse x dhe n atëherë janë statistikisht të pavarura Duke zëvendësuar këtë raport me atë të mëparshëm, marrim (7-12). Natyrisht, nëse zhurma është shtesë dhe nuk varet nga sinjali i hyrjes, atëherë shpejtësia maksimale e transmetimit të mesazhit mbi kanalin e komunikimit (xhiros maksimale) arrihet kur maxH(y), sepse Konsideroni një kanal komunikimi Gaussian bazuar në supozimet e mëposhtme: gjerësia e brezit të kanalit është e kufizuar nga frekuenca f c; zhurma e kanalit - e bardhë normale me fuqi mesatare për njësi të gjerësisë së brezit S n = S n 2; fuqia mesatare e dobishme e sinjalit Rx; sinjali dhe zhurma janë statistikisht të pavarura; sinjali i daljes është i barabartë me shumën e sinjalit të dobishëm dhe zhurmës. Natyrisht, në përputhje me formulën (7-4), xhiroja e një kanali të tillë përcaktohet si H(n)=Flog2πeS n f c. (7-14) Meqenëse sinjali dhe zhurma janë statistikisht të pavarura, ato nuk janë të ndërlidhura me njëri-tjetrin, kështu që fuqia mesatare e sinjalit total P y \u003d P x + S n f c \u003d P x + P n Në përputhje me formulën (7-13), është e nevojshme të gjendet entropia maksimale e sinjalit y(t) për mostër me një fuqi mesatare të caktuar. Për shkak të vetive ekstreme të entropisë (shih kapitullin 6), sinjali y(t) duhet të shpërndahen normalisht. Zhurmë e bardhë në brez fcështë ekuivalente me një sinjal në të njëjtin brez me një densitet spektral S, nëse fuqitë mesatare të tyre janë të barabarta, d.m.th. Në të vërtetë, për një sinjal normal, formula për entropinë për mostër u vërtetua Më parë, kemi konsideruar kodimin dhe transmetimin e informacionit përmes një kanali komunikimi në rastin ideal kur procesi i transmetimit të informacionit kryhet pa gabime. Në realitet ky proces shoqërohet në mënyrë të pashmangshme me gabime (shtrembërime). Kanali i transmetimit në të cilin është i mundur shtrembërimi quhet kanal i zhurmshëm

(ose zhurmë). Në një rast të veçantë, gabimet ndodhin gjatë vetë kodimit, dhe më pas koduesi mund të konsiderohet si një kanal i zhurmshëm. Prania e ndërhyrjes çon në humbjen e informacionit. Për të marrë sasinë e kërkuar të informacionit nga marrësi në prani të ndërhyrjeve, duhet të merren masa të veçanta. Një masë e tillë është futja e të ashtuquajturit "tepricë" në mesazhet e transmetuara; në këtë rast, burimi i informacionit jep dukshëm më shumë simbole sesa do të ishte e nevojshme në mungesë të ndërhyrjes. Një formë e prezantimit të tepricës është thjesht të përsërisni mesazhin. Kjo teknikë përdoret, për shembull, me dëgjim të dobët në telefon, duke përsëritur çdo mesazh dy herë. Një mënyrë tjetër e njohur për të rritur besueshmërinë e transmetimit është transmetimi i fjalës "me shkronjë" - kur në vend të secilës shkronjë transmetohet një fjalë (emër) e njohur që fillon me këtë shkronjë. Kapaciteti i kanalit kur numri i simboleve elementare është më shumë se dy dhe kur shtrembërimet e simboleve individuale janë të varura mund të përcaktohet duke përdorur teoremën e dytë të Shannon-it. Duke ditur kapacitetin e kanalit, është e mundur të përcaktohet kufiri i sipërm i shpejtësisë së transferimit të informacionit mbi një kanal të zhurmshëm. Shqyrtoni një shembull: Le të ketë një burim informacioni X, entropia e të cilit për njësi të kohës është e barabartë me , dhe një kanal me një gjerësi brezi X. Atëherë nëse atëherë me çdo kodim, transmetimi i mesazheve pa vonesa dhe shtrembërime është i pamundur. atëherë është gjithmonë e mundur të kodohet një mesazh mjaft i gjatë në mënyrë që ai të transmetohet pa vonesa dhe shtrembërime me një probabilitet arbitrar afër një. Detyra 2: Gjeni nëse gjerësia e brezit të kanaleve është e mjaftueshme për të transmetuar informacionin e dhënë nga burimi, nëse ka një burim informacioni me entropi për njësi të kohës \u003d 110 (dy njësi) dhe numri i kanaleve të komunikimit n=2, secila prej tyre mund të transmetojë për njësi të kohës K = 78 karaktere binare (0 ose 1); çdo shenjë binare zëvendësohet nga e kundërta e saj me probabilitet μ=0.17. η(μ) = 0,434587 η(1 – μ) = 0,223118 η(μ) + η(1 – μ) = 0,434587 + 0,223118 = 0,657688 Për një karakter, informacioni humbet 0.584239 (njësi të dyfishta). Kapaciteti i kanalit është i barabartë me: C \u003d 78 ∙ (1 - 0,657688) \u003d 26,7 ≈ 27 njësi binare për njësi të kohës. Sasia maksimale e informacionit që mund të transmetohet në dy kanale për njësi të kohës: 27∙2 = 54 (dy njësi), që nuk mjafton për të siguruar transmetimin e informacionit nga burimi, pasi burimi transmeton 110 int. njësi për njësi të kohës. Për të siguruar transmetimin e informacionit në vëllim të mjaftueshëm dhe pa shtrembërim, është e nevojshme të rritet numri i kanaleve të komunikimit deri në tre. Pastaj sasia maksimale e informacionit që mund të transmetohet në tre kanale për njësi të kohës: 3*54=162 njësi binare për njësi kohe. 162>110, prandaj, informacioni do të transmetohet pa shtrembërim. Për të transferuar informacione pa vonesë, mund të: 1. Përdorni metodën e kodimit-dekodimit; 2. Aplikoni përmbledhjen e sinjalit; 3. Rritja e fuqisë së transmetuesit; 4. Përdorni linja të shtrenjta komunikimi me mbrojtje efektive dhe pajisje me zhurmë të ulët për të reduktuar ndërhyrjet; 5. Aplikoni transmetues dhe pajisje të ndërmjetme me nivel të ulët zhurme; 6. Përdorni për kodimin e më shumë se dy gjendjeve; 7. Aplikoni sisteme komunikimi diskrete duke përdorur të gjitha parcelat për të transmetuar informacion. ©2015-2019 sajti Në çdo sistem komunikimi, informacioni transmetohet përmes një kanali. Shpejtësia e tij e transmetimit varet jo vetëm nga vetë kanali, por edhe nga vetitë e sinjalit të aplikuar në hyrjen e tij dhe për këtë arsye nuk mund ta karakterizojë kanalin si një mjet transmetimi informacioni. Le të gjejmë një mënyrë për të vlerësuar aftësinë e kanalit për të transmetuar informacion. Për çdo burim, sasia e informacionit të transmetuar në kanal merr vlerën e vet. Sasia maksimale e informacionit të transmetuar, e marrë nga të gjitha burimet e mundshme të sinjalit hyrës, karakterizon vetë kanalin dhe quhet gjerësia e brezit të kanalit për simbol: Bit/char. (ku maksimizimi kryhet mbi të gjitha shpërndarjet e probabilitetit me shumë variacione P(A)) Është gjithashtu e mundur të përcaktohet gjerësia e brezit C të kanalit për njësi të kohës. Llogaritni xhiron e një kanali simetrik pa memorie Vlera E para nga këto vlera ndodh me probabilitetin P, dhe e dyta me probabilitetin (1-P). Gjithashtu, duke qenë se është duke u konsideruar një kanal pa kujtesë, rezultatet e marrjes së simboleve individuale janë të pavarura nga njëra-tjetra. Prandaj, H(B/A) nuk varet nga shpërndarja e probabilitetit në ansamblin A, por përcaktohet vetëm nga probabilitetet e tranzicionit të kanalit. Kjo veti ruhet për të gjitha modelet me zhurmë shtesë. Duke zëvendësuar (2.27) në (2.26) marrim: Meqenëse vetëm termi H(B) në anën e djathtë varet nga shpërndarja e probabilitetit P(A), është ky term që duhet maksimizuar. Vlera maksimale e H(B) është e barabartë me log m dhe realizohet kur të gjitha simbolet e marra janë njësoj të mundshme dhe të pavarura nga njëri-tjetri. Është e lehtë të verifikohet se ky kusht është i plotësuar nëse simbolet hyrëse janë njësoj të mundshme dhe të pavarura, pasi në këtë rast Në të njëjtën kohë dhe Prandaj xhiroja për njësi të kohës Për një kanal binar simetrik (m=2) xhiros në njësi binare për njësi të kohës Varësia nga P sipas formulës (2.31) Me P=1/2, kapaciteti i kanalit binar është C=0, pasi me një probabilitet të tillë gabimi sekuenca e simboleve binare dalëse mund të merret pa transmetuar fare sinjale mbi kanal, por duke i zgjedhur ato në mënyrë të rastësishme (për shembull, sipas rezultateve të hedhjes së një monedhe), domethënë me P= 1/2 sekuencat në dalje dhe në hyrje të kanalit janë të pavarura. Rasti C=0 quhet ndërprerje kanali. Fakti që xhiroja në P=1 në një kanal binar është e njëjtë me atë në P=0 (kanal pa zhurmë) shpjegohet me faktin se në P=1 mjafton të përmbysësh të gjitha simbolet e daljes (d.m.th., të zëvendësosh 0. me 1 dhe 1 me 0 ) për të rivendosur siç duhet sinjalin e hyrjes. Rrjedha e një kanali të vazhdueshëm llogaritet në mënyrë të ngjashme. Le të, për shembull, kanali ka një gjerësi të kufizuar brezi me gjerësi F. Atëherë sinjalet U(t) dhe Z(t), përkatësisht, janë në hyrje dhe dalje të kanalit sipas teoremës. Kotelnikov përcaktohen nga mostrat e tyre të marra përmes intervalit 1 / (2F), dhe për këtë arsye informacioni që kalon nëpër kanal për ca kohë T është i barabartë me shumën e sasisë së informacionit të transmetuar për secilën mostër të tillë. Gjerësia e brezit të kanalit për një mostër të tillë: Këtu U dhe Z janë variabla të rastësishëm - seksione të proceseve U(t) dhe Z(t) në hyrje dhe dalje të kanalit, përkatësisht, dhe maksimumi merret mbi të gjitha sinjalet hyrëse të pranueshme, domethënë mbi të gjitha shpërndarjet U. . Rrjedha C përcaktohet si shuma e vlerave të marra mbi të gjitha mostrat për sekondë. Në këtë rast, natyrisht, entropitë diferenciale në (2.35) duhet të llogariten duke marrë parasysh marrëdhëniet probabiliste midis leximeve. Le të llogarisim kapacitetin e një kanali të vazhdueshëm pa memorie me zhurmë shtesë të bardhë Gaussian që ka një gjerësi brezi me gjerësi F nëse fuqia mesatare e sinjalit është . Fuqia e zhurmës (dispersioni) në brezin F shënohet me . Leximet e sinjaleve të daljes dhe të hyrjes, si dhe zhurma N, lidhen me barazinë: Meqenëse N ka një shpërndarje normale me pritshmëri matematikore zero, atëherë dendësia e probabilitetit të kushtëzuar për një U fikse do të jetë gjithashtu normale - me pritje matematikore U dhe variancë . Gjerësia e brezit për mostër përcaktohet nga formula (2.32): Sipas (2.24), entropia diferenciale e kushtëzuar h(Z/U) e shpërndarjes normale nuk varet nga pritshmëria matematikore dhe është e barabartë me . Prandaj, për ta gjetur atë, duhet gjetur një dendësi e tillë e shpërndarjes në të cilën h(Z) është maksimizuar. Nga (2.33), duke marrë parasysh që U dhe N janë variabla të rastësishme të pavarura, kemi për varianca Kështu, varianca është fikse, pasi dhe janë dhënë. Siç dihet, me një variancë fikse, entropia diferenciale maksimale sigurohet nga shpërndarja normale. Nga (2.33) shihet se me një shpërndarje normale njëdimensionale U, shpërndarja Z do të jetë gjithashtu normale dhe, për rrjedhojë, sigurohet maksimumi i entropisë diferenciale (2.24). Duke iu kthyer xhiros C për sekondë, vërejmë se informacioni i transmetuar në disa mostra është maksimal kur mostrat e sinjalit janë të pavarura. Kjo mund të arrihet nëse sinjali U(t) zgjidhet në mënyrë që dendësia e tij spektrale të jetë uniforme në brezin F. Mostrat e ndara me intervale që janë shumëfisha të 1/(2F) janë reciprokisht të pakorreluara, dhe për vlerat Gaussian, i pakorreluar do të thotë i pavarur . Prandaj, xhiroja C (për sekondë) mund të gjendet duke shtuar xhiron (2.35) për mostrat e pavarura 2F: Realizohet nëse U(t) është një proces Gaussian me një dendësi spektrale uniforme në brezin e frekuencës F (zhurmë pothuajse e bardhë). Mund të shihet nga (2.36) se nëse fuqia e sinjalit nuk do të kufizohej, atëherë xhiroja do të ishte arbitrarisht e madhe. Shpejtësia është zero nëse raporti sinjal-zhurmë në kanal është zero. Me një rritje të këtij raporti, xhiroja rritet pafundësisht, por ngadalë, për shkak të varësisë logaritmike. Lidhja (2.36) quhet formula e Shannon-it. Kjo formulë është e rëndësishme në teorinë e informacionit, pasi përcakton varësinë e xhiros së kanalit të vazhdueshëm të konsideruar nga karakteristikat e tij teknike si gjerësia e brezit dhe raporti sinjal-zhurmë. Formula e Shannon tregon mundësinë e shkëmbimit të gjerësisë së brezit për fuqinë e sinjalit dhe anasjelltas. Sidoqoftë, meqenëse C varet linearisht nga F, dhe në - sipas një ligji logaritmik, zakonisht nuk është fitimprurëse të kompensohet një reduktim i mundshëm i gjerësisë së brezit duke rritur fuqinë e sinjalit. Më efikas është shkëmbimi i kundërt i fuqisë së sinjalit për gjerësinë e brezit. Sasia maksimale e informacionit që mund të transmetohet mesatarisht në një kanal të vazhdueshëm në kohë, Për një kanal Gaussian Vini re se kur Shprehja (2.37) përkon me karakteristikën e quajtur kapaciteti (volumi) i kanalit.

Nëse keni nevojë të gjeni një ekstrem (maksimum, minimal ose pikë shale) të një funksioni prej n variablash f(x1, x2, …, xn) të lidhur me k

Supozoni se ekziston një mesazh i përbërë nga n shkronja: , ku j=1, 2, …, n ─ numrat e shkronjave në mesazh në rend, dhe i1, i2, … ,në numra

Tani supozojmë se elementet e mesazhit (shkronjat) janë të ndërvarura. Në këtë rast, probabiliteti i shfaqjes së një sekuence prej disa shkronjash nuk është i barabartë me produktin e probabiliteteve të ndodhjes.

Siç u përmend, entropia është maksimale nëse probabilitetet e mesazheve ose simboleve nga të cilat ato përbëhen janë të njëjta. Mesazhe të tilla përmbajnë informacionin maksimal të mundshëm. Nëse mesazhi ka

Masa e përmbajtjes shënohet me kont (nga anglishtja Content ─ content). Përmbajtja e ngjarjes I shprehet nëpërmjet funksionit të masës së përmbajtjes së saj rreth

Nëse informacioni përdoret në sistemet e menaxhimit, atëherë është e arsyeshme të vlerësohet dobia e tij nga efekti që ai ka në rezultatin e menaxhimit. Në këtë drejtim, në vitin 1960, shkencëtari sovjetik A.A.

Këtu entropia konsiderohet si funksion i kohës. Në këtë rast, qëllimi është të shpëtojmë nga pasiguria, d.m.th. arrihet një pozicion ku entropia është e barabartë me 0. Kjo situatë është tipike për problemet

Të dhënat e papërpunuara shpesh paraqiten si vlera të vazhdueshme, si temperatura e ajrit ose e ujit të detit. Prandaj, është me interes të matet sasia e informacionit që përmbahet në mesazhe të tilla.

Ndryshorja e rastësishme a është e kufizuar nga intervali . Në këtë rast, integrali i caktuar i densitetit të shpërndarjes së probabilitetit të tij (ligji diferencial i shpërndarjes së probabilitetit) në

Le të supozojmë tani se fusha e përcaktimit të vlerave të një ndryshoreje të rastësishme nuk është e kufizuar, por janë dhënë varianca e saj D dhe pritshmëria matematikore M. Vini re se varianca është drejtpërdrejt proporcionale me

Sinjalet e vazhdueshme - bartës të informacionit - janë funksione të vazhdueshme të një argumenti të vazhdueshëm - koha. Transmetimi i sinjaleve të tilla mund të kryhet duke përdorur kanale komunikimi të vazhdueshme,

Llojet më të thjeshta dhe më të përdorura të kuantizimit janë: · kuantizimi sipas nivelit (thjesht do të themi kuantizimi); kuantizimi i kohës (ne do të thërrasim

Si rezultat i konvertimit të anasjelltë nga një formë e vazhdueshme-diskrete në një të vazhdueshme, merret një sinjal që ndryshon nga ai origjinal për nga sasia e gabimit. Sinjali quhet funksioni riprodhues

Teoria spektrale e përgjithësuar e sinjaleve kombinon metodat e përshkrimit matematikor të sinjaleve dhe zhurmës. Këto metoda bëjnë të mundur sigurimin e tepricës së kërkuar të sinjaleve në mënyrë që të zvogëlohet efekti i ndërhyrjes.

Një skemë e mundshme për kuantizim-transmetim-rikuperim të një sinjali të vazhdueshëm mund të përfaqësohet siç tregohet në Fig. 2.5. Oriz. 2.5. Skema e mundshme kuantizimi-transferimi

Si rezultat i kuantizimit kohor të funksionit x(t), fitohet një seri vlerash x(t1), x(t2), … e sasisë së kuantizuar x(t) në kohët diskrete t.

Funksioni riprodhues në shumicën e rasteve llogaritet me formulën: , ku janë disa funksione. Këto karakteristika zakonisht priren të zgjedhin në mënyrë që. (2.14) Në këtë rast,

Gjeni gabimin e interpolimit. Le ta paraqesim atë si: , (2.16) ku K(t) është një funksion ndihmës që gjendet. Për t* arbitrare kemi: (

Interpolimi me polinome të rendit të n-të konsiderohet në mënyrë të ngjashme me rastet e mëparshme. Në këtë rast, vërehet një ndërlikim i rëndësishëm i formulave. Përgjithësimi çon në një formulë të formës së mëposhtme:

Merrni parasysh rastin e diskretimit të një procesi ergodik stacionar të rastësishëm x(t) me një funksion të njohur korrelacioni. Ne do të rivendosim duke përdorur polinomet e Lagranzhit. Më shpesh

Figura 2.13 ilustron parimin e kuantizimit të nivelit. Oriz. 2.13. Kuantizimi i nivelit. Ky kuantizim reduktohet në zëvendësimin e vlerës së sinjalit të nivelit origjinal

Oriz. 2.19. Shënim Le të vendosim tani numrin e hapave të kuantizimit n, kufijtë e intervalit (xmin, xmax

Kodimi është operacioni i identifikimit të karaktereve ose grupeve të karaktereve të një kodi me karaktere ose grupe karakteresh të një kodi tjetër. Kodi (kodi francez), një grup njohurish

Disa veti të përgjithshme të kodeve. Le të shohim shembuj. Le të supozojmë se një burim diskret pa memorie, d.m.th. duke dhënë mesazhe të pavarura - shkronja - në dalje, duke pasur

Teorema 1. Nëse numrat e plotë n1, n2, ..., nk plotësojnë pabarazinë (3.1), ekziston një kod parashtesë me një alfabet me madhësi m,

Formulimi. Le të jepet një kod me gjatësinë e fjalëve kodike n1, n2, … , nk dhe me një alfabet me vëllim m. Nëse kodi është i dekodueshëm në mënyrë unike, atëherë pabarazia e Kraft kënaq

Formulimi. Duke pasur parasysh entropinë H të burimit dhe vëllimin m të alfabetit dytësor, ekziston një kod prefiks me gjatësinë mesatare minimale nav min.

Le të shqyrtojmë tani rastin e kodimit jo të shkronjave burimore individuale, por të sekuencave të shkronjave L. Teorema 4. Deklaratë. Për një burim të caktuar diskret

Përkufizimet. Kodet e pabarabarta janë kode, fjalët e kodit të të cilëve kanë gjatësi të ndryshme. Optimaliteti mund të kuptohet në mënyra të ndryshme, në varësi të

Formulimi. Për çdo burim me k>=2 shkronja, ekziston një kod binar optimal (në kuptimin e gjatësisë mesatare minimale të një fjale kodi) në të cilin dy shtresat më pak të mundshme

Formulimi. Nëse një kod prefiks i ansamblit të reduktuar U" është optimal, atëherë kodi përkatës i prefiksit të ansamblit origjinal m

1. Shkronjës së alfabetit parësor me probabilitetin më të vogël të paraqitjes i caktohet kodi me gjatësinë më të madhe (Lemma 1), d.m.th. një kod i tillë është jo i njëtrajtshëm (me gjatësi të ndryshme të fjalëve kodike). Në r

Siç nënkupton edhe emri, një kodim i tillë është krijuar për të eliminuar efektet e dëmshme të ndërhyrjes në kanalet e transmetimit të informacionit. Tashmë është raportuar se një transmetim i tillë është i mundur si në hapësirë ashtu edhe në hapësirë.

Vetia e kodeve të korrigjimit të gabimeve për të zbuluar dhe korrigjuar gabimet varet shumë nga karakteristikat e ndërhyrjes dhe kanalit të transmetimit të informacionit. Teoria e informacionit zakonisht konsideron dy të thjeshta

Supozoni se fjala kod përbëhet nga n simbole binare. Probabiliteti i mos shtrembërimit të fjalës kodike, siç është e lehtë të vërtetohet, është e barabartë me: . Probabiliteti i shtrembërimit të një karakteri (i vetëm

Për thjeshtësi, merrni parasysh kodin e bllokut. Me ndihmën e tij, çdo k bit (shkronja) të sekuencës hyrëse i caktohet një fjalë kodi n-bit. Sasi të llojeve të ndryshme

Q-ja e lidhur Hamming përcakton numrin maksimal të mundshëm të fjalëve kodike të lejuara të një kodi uniform për një fjalë kodi të caktuar gjatësi n dhe aftësinë korrigjuese të kodit CSC

Një nga karakteristikat e një kodi është teprica e tij. Rritja e tepricës është, në parim, e padëshirueshme, pasi rrit volumin e të dhënave të ruajtura dhe të transmetuara, megjithatë, për të luftuar shtrembërimet, tepricat

Konsideroni një klasë kodesh algjebrike të quajtura lineare. Përkufizimi: Kodet lineare quhen kode blloku, shifra shtesë të të cilave formohen

Për të përcaktuar numrin e shifrave shtesë, mund të përdorni formulën e kufirit Hamming: . Në këtë rast, mund të merret një kod i mbushur dendur, d.m.th. kod me minimumin për çiftet e dhëna

Kodet lineare kanë vetinë e mëposhtme: nga grupi i përgjithshëm i 2k fjalëve kodike të lejuara, të cilat, meqë ra fjala, formojnë një grup, është e mundur të zgjidhen nënbashkësi të k fjalëve që kanë

Procedura e mësipërme për ndërtimin e një kodi linear ka një sërë disavantazhesh. Është e paqartë (MDS mund të specifikohet në mënyra të ndryshme) dhe është i papërshtatshëm në zbatim në formën e pajisjeve teknike. Këto mangësi

Të gjitha vetitë e kodeve ciklike përcaktohen nga një polinom gjenerues. 1. Një kod ciklik, polinomi formues i të cilit përmban më shumë se një term, zbulon të gjitha gabimet e vetme.

Ekziston një procedurë e thjeshtë për të ndërtuar një kod me një aftësi të caktuar korrigjuese. Ai përbëhet nga sa vijon: 1. Sipas një madhësie të dhënë të komponentit të informacionit të një fjale kodi me gjatësi

Kodet ciklike, si çdo kod linear, mund të përshkruhen duke përdorur matrica. Kujtojmë se KC(X) = gm(X)*U(X) . Kujtoni edhe shembullin e rendit të shumëzimit

Është e qartë se polinomet e fjalës kodike KS(X) duhet të jenë të pjesëtueshëm me polinomin gjenerues g(X) pa mbetje. Kodet ciklike i përkasin klasës së kodeve lineare. Kjo do të thotë se për këto kode ekziston

Konsideroni kanalet që ndryshojnë në llojin e linjave të komunikimit të përdorura në to. 1. Mekanike, në të cilën lëvizja e çdo lëngu të ngurtë përdoret për të transferuar informacion

Tani hetojmë xhiron e një kanali komunikimi diskret me zhurmë. Ekzistojnë një numër i madh i modeleve matematikore të kanaleve të tilla. Më e thjeshta prej tyre është një kanal me të pavarur

Ne do të shqyrtojmë sekuencat e shkronjave statistikisht të pavarura. Sipas ligjit të numrave të mëdhenj, më të mundshmet janë sekuencat me gjatësi n, në të cilat, për numrin N

Formulimi Për një kanal diskret në zhurmë, ekziston një metodë e tillë kodimi që mund të sigurojë transmetim pa gabime të të gjithë informacionit që vjen nga burimi.

Teorema e Shannon-it për një kanal me zhurmë nuk tregon një metodë specifike kodimi që siguron transmetim të besueshëm të informacionit me një shpejtësi arbitrare afër kapacitetit të kanalit.

Konsideroni modelin e mëposhtëm të kanalit: 1. Kanali është i aftë të transmetojë lëkundje me frekuenca nën Fm. 2. Ka interferencë n(t) në kanalin, i cili ka një (gau

Kur futni një skedar teksti të ruajtur më parë, specifikoni llojin e skedarit *.*. Kjo do t'ju lejojë të shihni të gjithë skedarët në listë gjatë përzgjedhjes. Specifikoni skedarin tuaj. Pas kësaj, dritarja M do të shfaqet në ekran.

Siç përshkruhet në hyrjen teorike, entropia mesatare gjendet duke përdorur formulat 1 dhe 2. Në të dyja rastet, ju duhet të gjeni probabilitetet e shfaqjes së shkronjave ose kombinimeve me dy shkronja. Probabilitetet mund të jenë

Paraqisni rezultatet e llogaritjes në formën e një tabele:<Язык 1>

<Язык

Kontrolli programatik i aplikacioneve që janë pjesë e Microsoft Office kryhet duke përdorur të ashtuquajturat makro. Fjala makro është me origjinë greke. Përkthimi

Përpara se të krijoni funksione të personalizuara, duhet të hapni skedarin në një libër pune që përmban informacionin që dëshironi të përpunoni duke përdorur këto funksione të personalizuara. Nëse ky libër pune ka qenë më parë

Regjistrimi fillon dhe përfundon duke shtypur butonin Regjistro (Fig. 5), të shënuar me një rreth të kuq. Gjatë procesit të regjistrimit, butoni Regjistro duket i shtypur dhe më i lehtë (i theksuar).

Klikoni dy herë për të hapur një skedar teksti me të dhëna të eksportuara nga programi Wavosaur (Fig. 23). Oriz. 23. Pamje e përafërt e të dhënave Mund të shihet se të eksportuara

Kuantizimi i nivelit është një kusht i domosdoshëm për shndërrimin e një sinjali të vazhdueshëm në formë dixhitale. Sidoqoftë, për këtë nuk mjafton vetëm kuantizimi i nivelit - për shndërrimin në formë dixhitale

Ky algoritëm përdoret për të ndërtuar procedurën për ndërtimin e një kodi optimal, të propozuar në vitin 1952 nga doktori i Institutit të Teknologjisë në Massachusetts (SHBA) David Huffman: 5) shkronjat e të parës

Konsideroni një alfabet me tetë shkronja. Është e qartë se në kodimin konvencional (jo statistikor), secila shkronjë kërkon tre karaktere për t'u paraqitur. Efekti më i madh

Ekzistojnë 2 parametra të tillë: koeficienti i kompresimit statistikor dhe koeficienti i efikasitetit relativ. Të dy parametrat karakterizojnë shkallën e zvogëlimit të gjatësisë mesatare të fjalës së kodit. Ndërsa gjatësia mesatare

5. Shkronjës së alfabetit parësor me probabilitet më të vogël të paraqitjes i caktohet kodi me gjatësinë më të madhe (Lemma 1), d.m.th. një kod i tillë është jo i njëtrajtshëm (me gjatësi të ndryshme të fjalëve kodike). Në r

Puna laboratorike nr. 4 kryhet nën kontrollin e një programi kontrolli të shkruar posaçërisht. Ky program kontrolli është i shkruar në Visual Basic 6. Skedari i ekzekutueshëm i programit mbart dhe

Kodet lineare kanë vetinë e mëposhtme: nga i gjithë grupi i 2k fjalëve kodike të lejuara, mund të zgjidhen nëngrupe k fjalësh që kanë vetinë e pavarësisë lineare

Fjala e koduar CS fitohet duke shumëzuar matricën e sekuencës së informacionit ||X|| në matricën gjeneruese ||OM||: ||KC1*n|| = ||X

Si rezultat i transmetimit të një fjale kodi përmes një kanali, ajo mund të shtrembërohet nga ndërhyrjet. Kjo do të rezultojë në kodin e marrë ||PCS|| mund të mos përputhet me origjinalin ||COP||.

Puna laboratorike nr.5, si puna nr.4, kryhet nën kontrollin e një programi kontrolli të shkruar në gjuhën algoritmike Visual Basic 6. Skedari i ekzekutueshëm i programit quhet Interference![]()

![]() quhet shpejtësia me të cilën informacioni transmetohet përmes një kanali komunikimi. Kjo vlerë është e barabartë me sasinë e informacionit relativ të transmetuar për njësi të kohës. Për një njësi kohore me një kanal komunikimi diskret, është e përshtatshme të merret parasysh koha e transmetimit të një simboli. Në këtë rast, formulat për shpejtësinë e transferimit të informacionit kuptojnë entropinë dhe sasinë e informacionit për simbol. Për kanalet e komunikimit të vazhdueshëm, përdoren dy njësi matëse, ose një njësi e përbashkët (për shembull, një sekondë), ose një interval kohor midis mostrave

quhet shpejtësia me të cilën informacioni transmetohet përmes një kanali komunikimi. Kjo vlerë është e barabartë me sasinë e informacionit relativ të transmetuar për njësi të kohës. Për një njësi kohore me një kanal komunikimi diskret, është e përshtatshme të merret parasysh koha e transmetimit të një simboli. Në këtë rast, formulat për shpejtësinë e transferimit të informacionit kuptojnë entropinë dhe sasinë e informacionit për simbol. Për kanalet e komunikimit të vazhdueshëm, përdoren dy njësi matëse, ose një njësi e përbashkët (për shembull, një sekondë), ose një interval kohor midis mostrave ![]() , në rastin e fundit, formulat nënkuptojnë entropi diferenciale për një numërim (ose shkallë lirie). Shpesh, manualet nuk tregojnë në mënyrë specifike se cila nga dy njësitë përdoret. Në këtë drejtim, një formulë tjetër përdoret shpesh për shkallën mesatare të transferimit të informacionit

, në rastin e fundit, formulat nënkuptojnë entropi diferenciale për një numërim (ose shkallë lirie). Shpesh, manualet nuk tregojnë në mënyrë specifike se cila nga dy njësitë përdoret. Në këtë drejtim, një formulë tjetër përdoret shpesh për shkallën mesatare të transferimit të informacionit![]()

![]()

![]()

![]()

![]()

Të gjitha të drejtat u përkasin autorëve të tyre. Kjo faqe nuk pretendon autorësinë, por ofron përdorim falas.

Data e krijimit të faqes: 13-02-2016Tema 2.5. Kapaciteti i kanalit të komunikimit

![]() (2.26)

(2.26) në këtë rast, është e lehtë të llogaritet, pasi probabiliteti i kushtëzuar (kalimtar) merr vetëm dy vlera: , nëse dhe (1-P), nëse .

në këtë rast, është e lehtë të llogaritet, pasi probabiliteti i kushtëzuar (kalimtar) merr vetëm dy vlera: , nëse dhe (1-P), nëse . (2.27)

(2.27)

![]() (2.34)

(2.34) (2.36)

(2.36) (2.37)

(2.37)