Portiamo alla vostra attenzione una descrizione completa del pannello di controllo del conducente. Si noti che alcune impostazioni sono disponibili solo per determinati tipi di apparecchiature utilizzate. In questa recensione, abbiamo cercato di riflettere tutte le impostazioni possibili.

Finestra del pannello principale

La finestra principale è mostrata nell'illustrazione:

La barra di navigazione si trova a sinistra e ti consente di navigare tra le impostazioni di cui hai bisogno con un clic. Il menu Visualizza ti consente di attivare la visualizzazione avanzata, che ti dà l'accesso più completo a tutte le funzionalità delle impostazioni del driver, o di impostare una visualizzazione pannello personalizzata, lasciando solo gli elementi che intendi utilizzare. Inoltre, nella parte in basso a sinistra del pannello, è previsto l'accesso al sistema di guida del pannello di controllo (link "Informazioni di sistema"):

dove puoi scoprire le versioni dei file, i driver installati e altri software NVIDIA, nonché le caratteristiche della scheda video.

Categoria Opzioni 3D

Regolazione delle immagini con anteprima

Sono disponibili le seguenti impostazioni:

- Impostazioni in base all'applicazione 3D— questa opzione consente di controllare la qualità e la velocità di visualizzazione tramite applicazioni 3D. Tuttavia, l'ottimizzazione del filtro trilineare abilitata per impostazione predefinita e l'ottimizzazione del campionamento dell'anisotropia vengono mantenute indipendentemente dalle impostazioni dell'applicazione.

- Impostazioni avanzate dell'immagine 3D- utilizza le impostazioni avanzate del driver impostate dagli utenti stessi. Il collegamento "Vai" ti dà accesso alla scheda "Gestisci impostazioni 3D". È la gestione delle opzioni driver aggiuntive che consente di ottenere la massima qualità dell'immagine.

- Impostazioni personalizzate incentrate su...: - l'opzione più interessante che consente la gestione semplificata delle opzioni driver aggiuntive per gli utenti inesperti:

Significato Prestazione corrisponde alla velocità massima e include le impostazioni: v-sync è disattivato, tutte le ottimizzazioni (ottimizzazione del filtro trilineare, ottimizzazione del filtro mip per anisotropia, ottimizzazione del campionamento per anisotropia) sono abilitate, livello di dettaglio negativo: divieto di livello negativo - acceso, texture filtraggio - "qualità", il filtraggio anisotropico e il livellamento sono controllati dalle applicazioni.

Significato Equilibrio ha le seguenti impostazioni: anti-aliasing - 2x, filtro anisotropo - 4x, tutte le ottimizzazioni (ottimizzazione del filtro trilineare, ottimizzazione del filtro anisotropia mip, ottimizzazione del campionamento dell'anisotropia) sono abilitate, il livello di dettaglio negativo è abilitato, il filtro delle texture è "qualità", v- la sincronizzazione è gestita dalle applicazioni.

Significato Qualità ha le seguenti impostazioni: ottimizzazione del filtro trilineare - abilitato, anti-aliasing - 4x, filtro anisotropico - 8x, livello di dettaglio negativo - abilitato, filtro delle texture - "qualità", sincronizzazione verticale - controllato dalle applicazioni.

Tutte le modalità sono fornite con spiegazioni dettagliate per il loro utilizzo e un logo aziendale rotante dimostra l'uso di determinate impostazioni.

Per impostazioni più dettagliate, utilizzare la finestra Gestisci le impostazioni 3D.

Gestisci le impostazioni 3D

Opzioni globali

Possibili impostazioni dei segnalibri Opzioni globali :

Filtraggio anisotropico. I valori possibili sono "Off", "Controllo applicazioni", "2x-16x" (a seconda del modello della scheda video). Il filtraggio anisotropico è di gran lunga la tecnica di compensazione della distorsione dei pixel più avanzata e, in combinazione con il filtraggio trilineare, offre la migliore qualità di filtraggio. L'attivazione di qualsiasi valore diverso da "Controllo per applicazione" consente di ignorare le impostazioni dell'applicazione. Ma non dobbiamo dimenticare che si tratta di un'impostazione molto dispendiosa in termini di risorse che riduce significativamente le prestazioni.

Impulso di sincronizzazione verticale. Possibili valori - "On". e Off, Usa l'impostazione 3D dell'applicazione. Per sincronizzazione verticale (non è del tutto chiaro il motivo per cui NVIDIA si è allontanata da questo termine) si intendono la sincronizzazione dell'output dell'immagine con la frequenza di aggiornamento del monitor. L'abilitazione della sincronizzazione verticale consente di ottenere l'immagine più fluida sullo schermo, disattivandola si ottiene il numero massimo di fotogrammi al secondo, portando spesso a un guasto (spostamento) dell'immagine dovuto al fatto che l'adattatore video è stato avviato disegnando il fotogramma successivo, mentre l'output del precedente non è ancora terminato. A causa dell'uso del doppio buffering, l'abilitazione di vsync può far sì che i fotogrammi al secondo scendano al di sotto della frequenza di aggiornamento del monitor in alcune applicazioni.

Abilita trame scalabili. I valori possibili sono "Nessuno" e "Bilineare", "Trilineare". Nessuno: non abilitare le trame scalabili nelle applicazioni che non le supportano. Bilineare - Migliori prestazioni a scapito della qualità. Trilineare: buona qualità dell'immagine con prestazioni più lente. L'utilizzo di questa opzione nella modalità di filtraggio bilineare forzato è altamente sconsigliato, poiché la qualità dell'immagine ottenuta forzando l'opzione è semplicemente deprimente.

Ombreggiatura dell'illuminazione di sfondo. Abilita la tecnologia Ambient Occlusion per simulare l'illuminazione globale (ombreggiatura). Il modello di illuminazione 3D tradizionale calcola l'aspetto di una superficie esclusivamente dalle sue caratteristiche e dalle caratteristiche delle sorgenti luminose. Gli oggetti nel percorso della luce proiettano ombre, ma non influiscono sull'illuminazione di altri oggetti nella scena. Il modello di illuminazione globale aumenta il realismo dell'immagine calcolando l'intensità della luce che raggiunge la superficie e il valore di luminosità di ciascun punto della superficie dipende dalla posizione relativa degli altri oggetti nella scena. Sfortunatamente, un onesto calcolo volumetrico dell'ombreggiatura causata da oggetti situati nel percorso dei raggi luminosi è ancora al di là delle capacità dell'hardware moderno. Pertanto, è stata sviluppata la tecnologia di occlusione ambientale, che consente di utilizzare gli shader per calcolare l'ombreggiatura reciproca degli oggetti nel piano della "camera virtuale" mantenendo prestazioni accettabili, utilizzata per la prima volta nel gioco Crysis. Questa opzione ti consente di applicare questa tecnologia per visualizzare i giochi che non hanno il supporto integrato per l'occlusione ambientale. Ogni gioco richiede un adattamento separato dell'algoritmo, quindi l'opzione stessa è abilitata nei profili del pilota e l'opzione del pannello consente solo l'uso della tecnologia nel suo insieme. Un elenco dei giochi supportati è disponibile sul sito Web NVIDIA. Supportato per GPU G80 (GeForce 8X00) e versioni successive a partire dal driver 185.81 in Windows Vista e Windows 7. Può ridurre le prestazioni del 20-50%. Possibili valori - "On". e "Off".

Numero massimo di frame pre-addestrati- consente di limitare il controllo del numero massimo di frame predisposti dal processore centrale quando disabilitato. In caso di problemi con la risposta lenta del mouse o del joystick, è necessario ridurre il valore di default (3). L'aumento del valore può aiutare a ottenere un'immagine più fluida con frame rate bassi.

Limitazione dell'estensione. I valori possibili sono "Abilitato" e "Disabilitato". Viene utilizzato per risolvere problemi di compatibilità con le vecchie applicazioni OpenGL a causa dell'overflow della memoria allocata in esse per archiviare informazioni sulle capacità della scheda video. In caso di arresto anomalo dell'applicazione, prova ad abilitare la restrizione dell'estensione.

Ottimizzazione dello streaming- consente di controllare la quantità utilizzata dalle applicazioni GPU, nella maggior parte dei casi, la modifica del valore predefinito (Auto) non richiede. Tuttavia, alcuni giochi meno recenti potrebbero non funzionare correttamente in queste configurazioni. Pertanto, è possibile controllare questa opzione.

Modalità di risparmio energetico. I valori possibili sono "Adaptive" (predefinito) e "Massime prestazioni". Con GeForce 9X00 e schede grafiche più recenti che hanno modalità di prestazioni suddivise, per giochi e programmi che mettono meno a dura prova la GPU, il driver non mette la scheda grafica in modalità prestazioni 3D. Questo comportamento può essere modificato selezionando la modalità "Prestazioni massime", quindi ogni volta che viene utilizzata la scheda grafica 3D, passerà alla modalità 3D. Queste funzionalità sono disponibili solo quando si utilizza il driver 190.38 o successivo in Windows Vista e Windows 7.

Smoothing - correzione gamma. Possibili valori "On" e "Off". Consente di eseguire la correzione gamma dei pixel durante l'anti-alias. Disponibile su schede video basate su GPU G70 (GeForce 7X00) e successive. Migliora la gamma di colori delle applicazioni.

Levigatura - trasparenza. I valori possibili sono Off, Campionamento multiplo, Sovracampionamento. Controlla una tecnologia anti-aliasing migliorata che riduce l'effetto "scalinata" ai bordi delle trame trasparenti. Attiriamo la vostra attenzione sul fatto che sotto la frase "Campionamento multiplo" è nascosto il termine più familiare "Campionamento multiplo" e in "Campionamento eccessivo" - "Campionamento". L'ultimo metodo ha l'impatto più significativo sulle prestazioni della scheda video. L'opzione funziona su schede video della famiglia GeForce 6x00 e successive, utilizzando driver versione 91.45 e successive.

Levigatura - opzioni. La voce è attiva solo se la voce "Smoothing - mode" è impostata su "Aumenta impostazioni applicazione" o "Sostituisci impostazioni applicazione". I valori possibili sono "Application control" (che equivale al valore "Application control" della voce "Anti-Aliasing - Mode"), e da 2x a 16x, comprese le modalità Q/S "proprietarie" (a seconda del capacità della scheda video). Questa impostazione influisce seriamente sulle prestazioni. Per le carte deboli, si consiglia di utilizzare le modalità minime. Va notato che solo le opzioni 8x, 16x e 16xQ avranno un effetto per la modalità "Aumento impostazioni applicazione".

Levigatura - Modalità. Abilita l'anti-aliasing delle immagini a schermo intero (FSAA). L'anti-alias viene utilizzato per ridurre al minimo l'effetto "frastagliatura" che si verifica ai bordi degli oggetti 3D. Possibili valori:

- "Controllo dell'applicazione" (valore predefinito) - l'anti-alias funziona solo se l'applicazione/il gioco lo richiede direttamente;

- "No" - disabilita completamente l'uso dell'anti-alias a schermo intero;

- "Ignora impostazioni applicazione" - forza l'anti-aliasing specificato nella voce "Anti-aliasing - Opzioni" da applicare all'immagine, indipendentemente dal fatto che l'applicazione utilizzi o meno l'anti-alias. "Sostituisci le impostazioni dell'applicazione" non avrà alcun effetto sui giochi che utilizzano la tecnologia Ombreggiatura differita e applicazioni DirectX 10 e versioni successive. Può anche causare la distorsione dell'immagine in alcuni giochi;

- Aumenta le impostazioni dell'applicazione (disponibile solo per GeForce 8X00 e schede grafiche più recenti): consente di migliorare l'anti-aliasing richiesto dalle applicazioni nelle aree problematiche a un costo delle prestazioni inferiore rispetto all'utilizzo dell'override delle impostazioni dell'applicazione.

Messaggio di errore. Controlla se le applicazioni possono verificare la presenza di errori di rendering. Il valore predefinito è "Off". molte applicazioni OpenGL eseguono questo controllo abbastanza spesso, il che degrada le prestazioni complessive.

Rilegatura della trama appropriata. Possibili valori - "Off". , "Hardware utilizzato", "Specifica OpenGL utilizzata". Per "texture binding" si intende il legame di coordinate di texture che vanno oltre i suoi limiti. Possono essere agganciati ai bordi dell'immagine o al suo interno. È possibile disabilitare lo snap in caso di difetti della trama in alcune applicazioni. Nella maggior parte dei casi, non è necessario modificare questa opzione.

Triplo buffering. Possibili valori - "On". e "Off". L'abilitazione del triplo buffering migliora le prestazioni quando si utilizza la sincronizzazione verticale. Tuttavia, va ricordato che non tutte le applicazioni consentono di forzare il triplo buffering e il carico sulla memoria video aumenta. Funziona solo per applicazioni OpenGL.

Accelerazione multipla del display. I valori possibili sono Modalità prestazioni display singolo, Modalità prestazioni display multiplo e Modalità compatibilità. L'impostazione definisce ulteriori opzioni OpenGL quando si utilizzano più schede grafiche e più display. Il pannello di controllo assegna l'impostazione predefinita. In caso di problemi con l'esecuzione di applicazioni OpenGL in configurazioni multi-GPU/Display, provare a modificare l'impostazione in Modalità compatibilità.

Texture Filtering - Ottimizzazione del filtraggio anisotropico. Possibili valori - "On". e "Off". Quando abilitato, il driver forza l'uso di un filtro mip point in tutte le fasi, ad eccezione di quella principale. L'abilitazione dell'opzione degrada leggermente la qualità dell'immagine e aumenta leggermente le prestazioni.

Filtraggio delle texture. I valori possibili sono Alta Qualità, Qualità, Prestazioni, Alte Prestazioni. Consente di controllare la tecnologia Intellisample. Il parametro ha un impatto significativo sulla qualità e sulla velocità dell'immagine:

- "High Performance" - offre il frame rate più alto possibile, che offre le migliori prestazioni.

- "Prestazione" - Impostazione delle prestazioni ottimali delle applicazioni con una buona qualità dell'immagine. Offre prestazioni ottimali e una buona qualità dell'immagine.

- "Qualità » è l'impostazione standard che offre la migliore qualità dell'immagine.

- "Alta qualità" - offre la migliore qualità dell'immagine. Viene utilizzato per ottenere immagini senza l'uso di ottimizzazioni software di filtraggio delle texture.

Filtraggio texture - odeviazione negativa di UD (livello di dettaglio). I valori possibili sono "Consenti" e "Binding". Le applicazioni a volte utilizzano un valore di livello di dettaglio (LOD) negativo per un maggiore filtraggio del contrasto delle trame. Ciò aumenta il contrasto di un'immagine fissa, ma l'effetto del "rumore" appare sugli oggetti in movimento. Per ottenere un'immagine migliore quando si utilizza il filtro anisotropico, è consigliabile impostare l'opzione su "scatta" per impedire la deviazione SP negativa.

Filtraggio texture - tottimizzazione lineare. Possibili valori - "On". e "Off". L'abilitazione di questa opzione consente al driver di ridurre la qualità del filtro trilineare per migliorare le prestazioni, a seconda della modalità Intellisample selezionata.

Impostazioni del software

Il segnalibro ha due campi:

Seleziona un programma da personalizzare.

In questo campo è possibile visualizzare i possibili profili dell'applicazione utilizzati per sovrascrivere le impostazioni globali del driver. Quando viene avviato il file eseguibile corrispondente, le impostazioni specifiche dell'applicazione vengono attivate automaticamente. Alcuni profili possono contenere impostazioni che non possono essere modificate dagli utenti. Di norma, si tratta dell'adattamento del driver per un'applicazione specifica o dell'eliminazione di problemi di compatibilità. Per impostazione predefinita, vengono visualizzate solo le applicazioni installate nel sistema.

Specificare le impostazioni per questo programma.

In questo campo è possibile modificare le impostazioni per un profilo di applicazione specifico. L'elenco delle impostazioni disponibili è completamente identico ai parametri globali. Il pulsante Aggiungi viene utilizzato per aggiungere i propri profili di applicazione. Quando si fa clic su di esso, si apre una finestra di Esplora risorse, con la quale si seleziona il file eseguibile dell'applicazione. Successivamente, nel campo "Specifica le impostazioni per questo programma", puoi impostare le impostazioni personali per l'applicazione. Il pulsante "Elimina" viene utilizzato per eliminare i profili dell'applicazione utente. Tieni presente che non è possibile rimuovere/modificare i profili dell'applicazione inizialmente presenti utilizzando il driver, per questo dovrai utilizzare utilità di terze parti come nHancer.

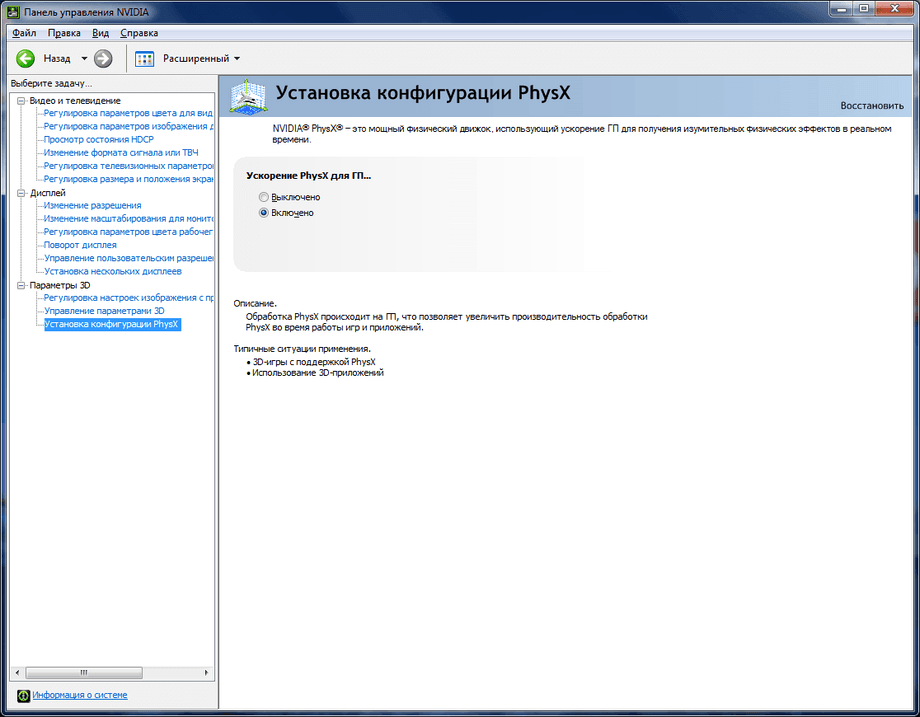

Installazione della configurazione PhysX

Consente di abilitare o disabilitare l'elaborazione degli effetti fisici utilizzando la tecnologia NVIDIA PhysX da parte della scheda video, purché basata su GPU G80 (GeForce 8X00) o successive. Il supporto è abilitato per impostazione predefinita, potrebbe essere necessario disabilitarlo quando si risolvono problemi con applicazioni che utilizzano PhysX in modo errato (ad esempio, il gioco Mirror`s Edge senza patch). Se nel sistema è presente più di una GPU NVIDIA, all'utente viene data la possibilità di selezionare la GPU su cui verranno elaborati gli effetti fisici, a meno che non venga utilizzata la modalità SLI. Puoi trovare maggiori dettagli sulle funzionalità dell'utilizzo di NVIDIA PhysX in una speciale sezione delle FAQ del nostro sito web.

Inoltre, a partire dalla versione del driver 195.62, puoi abilitare la visualizzazione dell'indicatore di accelerazione PhysX nei giochi. Per fare ciò, nel menu in alto " Opzioni 3D" seleziona " Mostra indicatore visivo PhysX". Lo stato di accelerazione viene visualizzato nell'angolo superiore sinistro dell'immagine.

Il tracker maschera trasforma la maschera in base al percorso di uno o più oggetti nel filmato. L'oggetto selezionato per il tracciamento durante tutto il film deve mantenere la stessa forma, ma può cambiare posizione, scala e/o prospettiva, purché tali modifiche non impediscano il tracciamento.

Quando viene selezionata una maschera, il pannello Tracciamento passa alla modalità di tracciamento maschera e visualizza i seguenti controlli:

- Traccia avanti o indietro per un fotogramma nel tempo o fino alla fine del livello

- Un metodo mediante il quale è possibile modificare la posizione, la scala, la rotazione, l'inclinazione e la prospettiva di una maschera

Seleziona la maschera e poi gli elementi Animazione > Traccia maschera. In alternativa, puoi anche tenere premuto il tasto CONTESTO e fare clic sulla maschera e selezionare maschera da pista nel menu contestuale per visualizzare il pannello Tracciamento.

Tracciamento della maschera.

l'effetto Ingrandisci mantenendo il livello di dettaglio consente di ingrandire notevolmente l'immagine, pur mantenendo i suoi piccoli elementi, nonché la nitidezza di linee e curve. Ad esempio, è possibile eseguire l'upscaling dei fotogrammi da SD a HD o da HD a proporzioni cinematografiche digitali.

Per ulteriori informazioni, vedere Zoom avanti mantenendo l'effetto livello di dettaglio.

Visualizzatori di contenuti HiDPI per schermi Retina su Mac

After Effects visualizza il contenuto sugli schermi Retina del Mac in modo che ogni pixel di contenuto nel visualizzatore appaia come un pixel separato sullo schermo.

Ciò influisce sul contenuto dei seguenti elementi:

- Pannello di metraggio

- Pannello dei livelli

- Pannello di composizione, inclusi i contenuti video e alcuni elementi dell'interfaccia utente nell'area dei contenuti

Questa funzione non ha effetto su cursori, pulsanti o altri pannelli nell'interfaccia utente di After Effects.

Funzionalità cinematografiche aggiornate

Ci sono due nuove opzioni nella finestra di dialogo Opzioni sotto Effetti Cinema. Possono essere utilizzati per configurare un'istanza di Cinema 4D da utilizzare insieme ad After Effects.

Percorso di rendering di Cinema 4D: seleziona la versione di Cinema 4D (R14 o R15) che verrà utilizzata per il rendering quando si lavora in After Effects.

Percorso per l'eseguibile di Cinema 4D: seleziona la versione di Cinema 4D da utilizzare quando si apre un file .c4d in After Effects, ad esempio utilizzando il comando Modifica originale.

Per ulteriori informazioni, vedere gli aggiornamenti di Cinema 4D.

Nuova libreria OptiX per il rendering 3D con ray-tracing

After Effects CC ora utilizza la nuova libreria OptiX 3.0. Le versioni precedenti di After Effects utilizzavano la libreria OptiX 2.0.

I principali vantaggi della nuova libreria OptiX rispetto alla vecchia libreria Optix 2.0 sono:

- Risolte le cause di arresto anomalo in Mac OS X v10.9 (Mavericks)

- Migliori prestazioni, anche in un ambiente multi-GPU

Bypass della whitelist per l'accelerazione della GPU in caso di rendering 3D con ray-tracing

La finestra di dialogo Dati GPU fornisce un menu di opzioni di ray tracing che consente all'utente di selezionare GPU o CPU.

Nelle versioni precedenti di After Effects, se l'hardware installato non era nell'elenco delle GPU testate e supportate, la voce corrispondente nel menu GB era disabilitata (disattivata) e veniva visualizzato un messaggio sotto il menu "GPU non disponibile - dispositivo o driver video incompatibile."

Gli utenti ora hanno accesso a una nuova opzione per la configurazione della GPU, fornita nel menu Modifica > Preferenze > Anteprima > Dati GPU: "Utilizza una GPU non testata e non supportata per accelerare il rendering 3D con il ray tracing CUDA."

Quando questa casella di controllo è selezionata, After Effects utilizza il rendering grafico 3D con ray-tracing accelerato utilizzando qualsiasi GPU che soddisfi i requisiti minimi.

Elenco delle nuove carte nella whitelist CUDA per OptiX

Le seguenti schede sono state aggiunte alla whitelist CUDA per OptiX (per il rendering 3D con accelerazione grafica):

- GTX 675MX (Windows e Mac OS)

- GTX 680MX (Windows e Mac OS)

- GTX 590 (Windows)

- GT 650M (aggiunto all'elenco delle mappe di Windows; già elencato su Mac OS)

- GTX 760 (Windows)

- GTX 770 (Windows)

- GTX 780 (Windows)

- GTX TITAN (Windows)

- Quadro K6000 (Finestre)

- Quadro K4000 (Finestre)

- Quadro K2000 (Finestre)

- Quadro K5000M (Finestre)

- Quadro K4000M (Finestre)

- Quadro K3000M (Finestre)

- Quadro K5100M (Finestre)

- Quadro K4100M (Finestre)

- Quadro K3100M (Finestre)

- Quadro K2100M (Finestre)

Prestazioni delle fasi di analisi migliorate per Tracker fotocamera 3D e Stabilizzatore di curvatura

Analisi video in background notevolmente accelerata per 3D Camera Tracker e Warp Stabilizer. A seconda delle informazioni sulla sequenza video e di altri fattori, gli indicatori ottenuti per aumentare la velocità di elaborazione nella fase di analisi (tracciamento) vanno dal 60% al 300%.

Proprietà migliorate e modificate

Mostra le proprietà con i fotogrammi chiave

I comandi per visualizzare le proprietà modificate nel pannello Timeline sono cambiati; il menu Animazione ora ha tre comandi per la visualizzazione delle proprietà:

- Mostra le proprietà con i fotogrammi chiave(tasto U) - visualizza qualsiasi proprietà a cui è associato il fotogramma chiave. Se a una proprietà sono associati sia i fotogrammi chiave che le espressioni, la proprietà viene visualizzata, ma l'espressione associata non viene visualizzata.

- Mostra le proprietà con animazione- Visualizza qualsiasi proprietà a cui è associato un fotogramma chiave o un'espressione.

- Mostra tutte le proprietà modificate(scorciatoia da tastiera: UU) - Visualizza fotogrammi chiave, espressioni o tutte le proprietà modificate (inclusi fotogrammi chiave ed espressioni) che non sono animate.

Proprietà di collegamento

- Seleziona una proprietà o un insieme di proprietà.

- Selezionare Modifica > Copia con link di proprietà.

- Incolla le proprietà su qualsiasi livello di qualsiasi composizione.

Le proprietà incollate ora mantengono la loro associazione con il livello da cui sono state copiate. Ciò garantisce che qualsiasi modifica apportata alla proprietà originale si rifletta in tutte le istanze di tale proprietà aggiunte tramite il collegamento.

Per creare duplicati che riflettano le modifiche apportate all'originale, puoi copiare e incollare l'intero livello con riferimenti alle proprietà. È inoltre possibile creare collegamenti a gruppi di proprietà presenti in un determinato livello. Ad esempio, per collegare tutte le proprietà di trasformazione senza selezionarle singolarmente, copia il gruppo di trasformazione e incollalo su un altro livello.

Nuove proprietà nel menu della lingua di espressione

Onde sonore corrette

In After Effects, le onde sonore sono rappresentate come onde sonore "corrette". Ciò significa che l'ampiezza del suono viene visualizzata in una sola direzione lungo l'asse orizzontale su scala logaritmica. Questo metodo di mappatura semplifica il calcolo del volume percepito.

Per passare al vecchio metodo di visualizzazione delle onde sonore, deseleziona Onde sonore corrette nel menu del pannello Timeline.

Modifiche allo snap di livello 2D e 3D

Sono state aggiunte due nuove opzioni accanto alla casella di controllo Ancoraggio nel pannello Strumenti:

Aggancia lungo i bordi estesi oltre i limiti del livello: abilitare lo snap a linee al di fuori dei limiti del livello. Ad esempio, eseguire lo snap lungo una linea definita espandendo il bordo di un livello nello spazio 3D. Questa funzione semplifica notevolmente l'allineamento dei livelli nello spazio 3D.

Associazione a funzioni all'interno di composizioni e livelli di testo compressi: rotazione dei wireframe interni per i livelli che si trovano all'interno di composizioni con trasformazioni compresse, nonché per i singoli caratteri nei livelli di testo 3D carattere per carattere. Con questa funzione è possibile, ad esempio, collegare il punto di ancoraggio di un livello a un altro livello nella composizione.

Abilita anteprima video per dispositivi esterni (Mac OS)

Per abilitare l'anteprima video su dispositivi esterni in Mac OS, seleziona la nuova opzione Abilita Anteprima video QuickTime nella categoria installazione Anteprima video. Quando selezioni questa casella, After Effects chiederà a QuickTime un elenco di dispositivi esterni per visualizzare in anteprima il video.

Attenzione! L'abilitazione di questa opzione potrebbe causare l'arresto anomalo di Adobe QT32 Server, che a sua volta provocherà l'arresto anomalo di After Effects.

Le versioni precedenti di After Effects richiedono automaticamente a QuickTime un elenco di dispositivi esterni per visualizzare l'anteprima del video.

Modifiche e miglioramenti alla funzionalità dei livelli

Punto di ancoraggio centrale

Il punto di ancoraggio che diventerà il centro del contenuto del livello può essere impostato nei seguenti modi:

- Livello> Trasforma> Centra punto di ancoraggio nel contenuto del livello

- Su Windows, usa la combinazione di tasti Ctrl+Alt+Home , su Mac OS, usa la combinazione di tasti Command+Option+Home .

- Puoi anche usare una combinazione Ctrl+doppio clic(Finestre) o Comando+doppio clic(Mac OS) per attivare lo strumento Panoramica indietro (punto di riferimento).

Per informazioni sui punti di ancoraggio, vedere Proprietà punto di ancoraggio.

Crea un nuovo livello

Impostazione della durata della precomposizione

Nella finestra di dialogo Precomposizione c'è una nuova opzione: Regola la durata della composizione all'intervallo di tempo dei livelli selezionati.

Seleziona questa opzione per creare una nuova composizione con la stessa durata dei livelli selezionati.

Nelle versioni precedenti di After Effects, la durata della nuova composizione è la stessa dell'originale, indipendentemente dalla durata dei livelli inclusi nella precomposizione.

Campionamento bicubico dell'effetto Trasforma

L'effetto Trasforma ha una nuova opzione di campionamento che può essere impostata su Bilineare o Bicubico.

Abilita registrazione

Selezionare Aiuto > Abilita registrazione per registrare le informazioni sulla sessione. I log generati verranno inviati a una serie di file di testo. Per avviare il processo di registrazione, riavviare l'applicazione. Per visualizzare i file di registro, selezionare Guida > Mostra file di registro.

Nota. La registrazione riduce leggermente le prestazioni, quindi la registrazione abilitata con questa impostazione verrà disabilitata dopo 24 ore.

Apri automaticamente le cartelle del pannello Progetto durante il trascinamento

.Ciao a tutti! Oggi è un articolo molto interessante sulla messa a punto di una scheda video per prestazioni elevate nei giochi per computer. Gli amici saranno d'accordo sul fatto che dopo aver installato il driver della scheda video, una volta aperto il "Pannello di controllo di Nvidia" e visto parole sconosciute lì: DSR, shader, CUDA, sync pulse, SSAA, FXAA e così via, hai deciso di non salire più lì. Tuttavia, è possibile e persino necessario capire tutto questo, perché le prestazioni della tua scheda video dipendono direttamente da queste impostazioni. C'è un'opinione errata che tutto in questo pannello complicato sia impostato correttamente per impostazione predefinita, sfortunatamente questo è tutt'altro che vero e gli esperimenti mostrano che l'impostazione corretta viene premiata con un aumento significativo del frame rate. Quindi preparati, capiremo l'ottimizzazione dello streaming, il filtraggio anisotropico e il triplo buffering. Di conseguenza, non te ne pentirai e verrai ricompensato con un aumento degli FPS nei giochi.

Quindi, per accedere al menu di controllo del driver video, fai clic con il pulsante destro del mouse in un punto qualsiasi del desktop e seleziona "Nvidia Control Panel" dal menu che si apre.

Quindi, nella finestra che si apre, vai alla scheda "Gestisci impostazioni 3D".

Eccoci qui con te e configureremo vari parametri che influiscono sulla visualizzazione delle immagini 3D nei giochi. Non è difficile capire che per ottenere le migliori prestazioni dalla tua scheda grafica, dovrai tagliare molto l'immagine in termini di qualità, quindi preparati.

Quindi il primo paragrafo CUDA - GPU". Ecco un elenco di processori video, uno dei quali puoi scegliere e verrà utilizzato dalle applicazioni CUDA. CUDA (Compute Unified Device Architecture) è un'architettura di elaborazione parallela utilizzata da tutte le moderne GPU per aumentare le prestazioni di elaborazione.

Il prossimo paragrafo " DSR - Scorrevolezza” saltiamo perché fa parte dell'impostazione della voce “DSR - Laurea”, e a sua volta deve essere disattivata e ora vi spiego perché.

DSR (Super Risoluzione Dinamica)- una tecnologia che ti consente di calcolare un'immagine nei giochi con una risoluzione più alta e quindi ridimensiona il risultato in base alla risoluzione del tuo monitor. Per farti capire perché questa tecnologia è stata inventata e perché non ne abbiamo bisogno per ottenere le massime prestazioni, cercherò di fare un esempio. Sicuramente hai notato spesso nei giochi che piccoli dettagli, come erba e fogliame, molto spesso tremolano o si increspano quando ti muovi. Ciò è dovuto al fatto che minore è la risoluzione, minore è il numero di punti di campionamento per la visualizzazione di dettagli fini. La tecnologia DSR corregge questo aumentando il numero di punti (maggiore è la risoluzione, maggiore è il numero di punti di campionamento). Spero che questo sarà chiaro. In condizioni di massime prestazioni, questa tecnologia non ci interessa perché consuma parecchie risorse di sistema. Bene, con la tecnologia DSR disabilitata, la regolazione della scorrevolezza, di cui ho scritto un po' più in alto, diventa impossibile. In generale, spegniamo e andiamo avanti.

Il prossimo arriva filtraggio antiisotropico. Il filtro antiisotropico è un algoritmo di computer grafica progettato per migliorare la qualità delle trame inclinate rispetto alla fotocamera. Cioè, quando si utilizza questa tecnologia, le trame nei giochi diventano più chiare. Se confrontiamo il filtraggio anti-isotropico con i suoi predecessori, vale a dire con il filtraggio bilineare e trilineare, il filtraggio anti-isotropico è il più vorace in termini di consumo di memoria della scheda video. Questo articolo ha una sola impostazione: la scelta del coefficiente di filtrazione. Non è difficile intuire che questa funzione debba essere disabilitata.

L'elemento successivo è impulso di sincronizzazione verticale. Questa è la sincronizzazione dell'immagine con la frequenza di aggiornamento del monitor. Se abiliti questa opzione, puoi ottenere il gameplay più fluido (lo strappo viene rimosso quando la fotocamera gira bruscamente), ma spesso si verificano cadute di fotogrammi al di sotto della frequenza di aggiornamento del monitor. Per ottenere il numero massimo di fotogrammi al secondo, è meglio disattivare questa opzione.

Riprese di realtà virtuale già preparate. Non ci interessa la funzione per gli occhiali per realtà virtuale, dal momento che la realtà virtuale è ancora lontana dall'uso quotidiano dei normali giocatori. Lasciamo l'impostazione predefinita: utilizzare l'impostazione dell'applicazione 3D.

Ombreggiatura dell'illuminazione di sfondo. Rende le scene più realistiche attenuando l'intensità dell'illuminazione ambientale sulle superfici oscurate dagli oggetti vicini. La funzione non funziona in tutti i giochi ed è molto impegnativa in termini di risorse. Pertanto, lo portiamo alla madre digitale.

Memorizzazione nella cache degli shader. Se abilitata, la CPU salva su disco gli shader compilati per la GPU. Se questo shader è nuovamente necessario, la GPU lo prenderà direttamente dal disco senza costringere la CPU a ricompilare questo shader. Non è difficile intuire che se si disabilita questa opzione, le prestazioni diminuiranno.

Numero massimo di frame pre-addestrati. Il numero di frame che la CPU può preparare prima che vengano elaborati dalla GPU. Più alto è il valore, meglio è.

Anti-alias multiframe (MFAA). Una delle tecnologie anti-aliasing utilizzate per eliminare le "frastagliature" ai bordi delle immagini. Qualsiasi tecnologia anti-aliasing (SSAA, FXAA) è molto impegnativa per la GPU (l'unica domanda è il grado di gola). Spegnetela.

Ottimizzazione dello streaming. Abilitando questa funzione, un'applicazione può utilizzare più CPU contemporaneamente. Nel caso in cui la vecchia applicazione non funzioni correttamente, prova a impostare la modalità "Auto" o a disabilitare del tutto questa funzione.

Modalità di risparmio energetico. Sono disponibili due opzioni: modalità adattiva e modalità a prestazioni massime. Durante la modalità adattiva, il consumo energetico dipende direttamente dal grado di utilizzo della GPU. Questa modalità è necessaria principalmente per ridurre il consumo di energia. Durante la modalità a prestazioni massime, come puoi immaginare, viene mantenuto il più alto livello possibile di prestazioni e consumo energetico, indipendentemente dal grado di carico della GPU. Mettiamo il secondo.

Antialiasing - FXAA, Antialiasing - correzione gamma, Antialiasing - opzioni, Antialiasing - trasparenza, Antialiasing - modalità. Ho già scritto di levigare un po' più in alto. Spegniamo tutto.

Triplo buffering. Una sorta di doppio buffering; un metodo di output dell'immagine che evita o riduce gli artefatti (distorsione dell'immagine). In parole semplici, aumenta la produttività. MA! Questa cosa funziona solo in tandem con la sincronizzazione verticale, che, come ricordi, abbiamo disattivato prima. Pertanto, disabilitiamo anche questo parametro, per noi è inutile.

Accelerazione GPU multi-display/mista. L'impostazione definisce opzioni aggiuntive per OpenGL quando si utilizzano più display e più schede grafiche. Display singolo - rispettivamente modalità prestazioni display singolo. Due o più: prestazioni multi-display (o modalità di compatibilità in caso di funzionamento errato delle applicazioni). Due o più schede video - modalità di compatibilità.

Filtraggio delle texture - Ottimizzazione del filtraggio antiisotropico. L'attivazione dell'opzione comporterà un leggero deterioramento dell'immagine e un aumento delle prestazioni, che è esattamente ciò di cui abbiamo bisogno.

Filtraggio delle texture - Qualità. Consente di controllare la tecnologia Intellisample. Questa tecnologia è progettata per migliorare la qualità delle scene uniformi con trame parzialmente trasparenti. Lo giriamo al minimo, ovvero impostiamo la modalità ad alte prestazioni.

Filtraggio texture - Deviazione LOD negativa. Una tecnologia che consente di visualizzare le texture in applicazioni con più contrasto.

Filtraggio delle texture - Ottimizzazione trilineare. L'abilitazione di questa opzione consente al conducente di ridurre la qualità del filtro trilineare per migliorare le prestazioni.

Questo completa l'ottimizzazione delle prestazioni del driver video Nvidia.

- Traduzione

Ciao, mi chiamo Tony Albrecht e sono uno degli sviluppatori del nuovo Render Strike Team nell'ambito della Sustainability Initiative at League of Legends. Il mio team è stato incaricato di apportare miglioramenti al motore di rendering LOL e ci siamo messi al lavoro felicemente. In questo articolo ti spiego come funziona il motore adesso. Spero che ponga una buona base su cui poter parlare in seguito dei cambiamenti che stiamo apportando. Questo articolo sarà una buona scusa per me per eseguire personalmente il processo di rendering passo dopo passo in modo che, come squadra, comprendiamo appieno cosa sta succedendo all'interno.

Spiegherò in dettaglio come LOL costruisce e renderizza ogni singolo fotogramma del gioco (ricordate che sulle macchine più potenti questo avviene oltre 100 al secondo). La storia sarà per lo più tecnica, ma spero sia di facile comprensione anche per chi non ha esperienza nel rendering. Per motivi di chiarezza, salterò alcune delle parti complicate, ma se vuoi conoscere i dettagli, scrivi a riguardo nei commenti [all'articolo originale].

Per prima cosa, parlerò un po' delle librerie grafiche che abbiamo. Lega dovrebbe funzionare nel modo più efficiente possibile su un'ampia gamma di piattaforme. In effetti, Windows XP è ora la quarta versione più popolare del sistema operativo che esegue il gioco (solo Windows 7, 10 e 8 sono più popolari). Ogni mese vengono eseguite dieci milioni di sessioni di gioco su Windows XP, quindi per mantenere la compatibilità con le versioni precedenti è necessario supportare DirectX 9 e utilizzare solo le funzionalità che fornisce. Utilizziamo anche un insieme comparabile di funzionalità OpenGL 1.5 su macchine OS X (questo cambierà presto).

Quindi iniziamo! Per prima cosa, impareremo come i computer eseguono effettivamente il rendering delle immagini.

Rendering per principianti

La maggior parte dei computer ha una CPU (unità di elaborazione centrale) e una GPU (unità di elaborazione grafica). La CPU esegue la logica e i calcoli del gioco, mentre la GPU riceve i dati del triangolo e delle texture dalla CPU e li visualizza come pixel sullo schermo. Piccoli programmi GPU chiamati shader ti consentono di influenzare il modo in cui viene eseguito il rendering. Ad esempio, puoi cambiare il modo in cui i triangoli sono strutturati o puoi dire alla GPU di eseguire calcoli per ogni texel in una trama. Pertanto, possiamo semplicemente strutturare un triangolo, aggiungere o moltiplicare più trame su un triangolo o eseguire processi più complessi come bump mapping, illuminazione, riflessi o persino skin shader altamente realistici. Tutti gli oggetti visibili vengono disegnati in un framebuffer non renderizzato, che viene renderizzato solo dopo che tutto il rendering è stato completato.Diamo un'occhiata a un esempio. Ecco un'immagine di Garen, composta da 6.336 triangoli che compongono una cornice "a filo" e un solido modello senza texture. Questo modello è stato creato dai nostri artisti ed esportato in un formato che il motore Lega può caricare e animare. (Si noti che Garen ha un'ombreggiatura non planare: questa è una limitazione dell'applicazione utilizzata per lo studio del rendering).

Questo modello non strutturato non è solo noioso, ma non mostra nemmeno il riconoscibile Garen. Per dare vita a Garen, devi applicare la texture.

Prima del caricamento, le trame di Garena vengono archiviate su disco come file DDS o TGA, che a loro volta sembrano una scena di un film dell'orrore. Dopo la corretta sovrapposizione sul modello, otteniamo il seguente risultato:

Stiamo già iniziando a ottenere qualcosa. Lo shader che rende le nostre mesh skinned non si limita alla texture, ma lo vedremo più avanti.

Quelle erano le basi, ma LOL molto di più deve essere renderizzato rispetto al modello e alla trama del personaggio. Esaminiamo i passaggi che compongono il rendering della scena seguente:

Rendering Fase 0: Nebbia di guerra

Prima di poter iniziare a disegnare parti della scena, dobbiamo prima preparare la nebbia della guerra e delle ombre (woo, "nebbia e ombre", che sinistro!). La nebbia di guerra viene memorizzata dalla CPU come una griglia 128x128, che viene quindi ridimensionata a una trama quadrata 512x512 (ulteriori informazioni su questo nell'articolo A Story of Fog and War). Sfociamo quindi questa texture e la applichiamo per scurire le aree rilevanti del gioco e della minimappa.

Rendering Fase 1: Ombre

Le ombre sono una parte essenziale di una scena 3D. Senza di essi, gli oggetti appariranno piatti. Per creare ombre che sembrano essere proiettate da un servitore o da un campione, dobbiamo renderle dal punto di luce. La distanza dalla sorgente di luce al personaggio che proietta l'ombra viene memorizzata per ogni pixel nei componenti RGB e impostiamo il componente di trasparenza alfa su zero. Questo può essere visto di seguito. Sulla sinistra abbiamo il campo dell'altezza dell'ombra RGB della torre sotto assedio, dei minion e dei due campioni. A destra, abbiamo solo il componente di trasparenza alfa. Queste texture sono state ritagliate per mostrare più chiaramente i dettagli delle ombre: servitori in basso, torre e campioni in alto.

Alla fine, sfoghiamo le ombre per dar loro un bel bordo liscio (insieme a una nuova ottimizzazione del frame rate). Di conseguenza, otteniamo una texture che può essere applicata alla geometria statica per ottenere l'effetto delle ombre.

Rendering Fase 2: Geometria statica

Con la nebbia di guerra e le texture delle ombre pronte, iniziamo a rendere il resto della scena nel frame. Innanzitutto la geometria statica (si chiama così perché è immobile). Questa geometria combina le informazioni della nebbia di guerra e delle ombre con la sua trama principale, dandoci la seguente scena:

Nota che le ombre dei servitori e la nebbia di guerra si insinuano ai bordi della scena. Il renderer Summoner's Rift non esegue il rendering di ombre dinamiche per la geometria statica. Poiché la fonte di luce principale non si muove, cuciniamo le ombre delle mesh statiche sulle loro trame. Ciò offre agli artisti un maggiore controllo sull'aspetto della mappa e migliora anche le prestazioni ( non richiede il rendering statico delle ombre della mesh.) Solo i minion, le torri e i campioni proiettano ombre.

Fase di rendering 3: mesh skinned

Quindi ora abbiamo il terreno e le ombre, quindi possiamo iniziare a sovrapporre gli oggetti su di essi. I servitori, i campioni e le torri vengono impilati per primi, ad es. tutti gli oggetti con cardini mobili che dovrebbero muoversi realisticamente.

Ogni maglia animata è composta da uno scheletro (una cornice di ossa collegate gerarchicamente) e una maglia di triangoli (vedi l'immagine di Garen sopra). Ogni vertice di ogni triangolo è attaccato da uno a quattro ossa, quindi quando le ossa vengono spostate, i vertici si muovono con loro come una pelle. Ecco perché sono chiamate “griglie spellate”. I nostri talentuosi artisti creano animazioni e mesh per tutti gli oggetti e poi li esportano in un formato in cui possono essere caricati Lega all'inizio del gioco.

Le immagini sopra mostrano tutte le ossa della mesh Garen. L'immagine a sinistra mostra tutte le sue ossa (con nomi). Nell'immagine a destra, le linee blu mostrano i vertici selezionati e le linee gialle mostrano le connessioni alle ossa che controllano la loro posizione.

Gli shader mesh skinned non solo disegnano mesh skin su un framebuffer, ma rendono anche la loro profondità ridimensionata su un altro buffer, che useremo in seguito per disegnare i contorni. Inoltre, gli shader di skinning calcolano i riflessi di Fresnel, l'illuminazione emessa, calcolano i riflessi e cambiano l'illuminazione per la nebbia di guerra.

Fase di rendering 4: contorni (contorno)

Per impostazione predefinita, è abilitato il contorno per le mesh con skin, che fornisce contorni più nitidi. Ciò consente alle mesh con skin di risaltare sullo sfondo, specialmente nelle aree a basso contrasto. Nelle immagini sottostanti, il contorno è disabilitato (a sinistra) e abilitato (a destra).

I contorni vengono creati prendendo la profondità scalata dal passaggio precedente ed elaborandola con l'operatore Sobel per estrarre il viso, che renderizziamo sulla mesh skinnata. Questa operazione viene eseguita separatamente per ciascuna maglia. Esiste anche un metodo di restituzione che utilizza il buffer del modello per le GPU che non possono eseguire il rendering di più oggetti contemporaneamente.

Rendering Fase 5: Erba

Per determinare cosa è coinvolto nella resa dell'acqua e dell'erba, diamo un'occhiata a un'altra scena.Ecco uno scatto senza acqua ed erba, solo una geometria statica dello sfondo e alcune mesh screpolate.

Nota che le ombre dell'erba fanno già parte della trama del terreno statico e non sono renderizzate in modo dinamico. Quindi aggiungiamo l'erba:

I cespi d'erba sono in realtà reti scuoiate. Questo ci permette di animarli mentre i personaggi ci camminano sopra e di dare loro una piacevole brezza ondeggiante in Summoner's Rift.

Rendering Fase 6: Acqua

Dopo l'erba, renderizziamo l'acqua usando reti traslucide con trame d'acqua leggermente animate. Quindi aggiungiamo foglie di ninfea, increspature attorno alle rocce e vicino alla riva, insetti. Tutti questi oggetti sono animati per dare vita alla scena.Per migliorare l'effetto dell'acqua (potrebbe essere troppo debole), ho mantenuto la trasparenza dell'acqua e ho ignorato la geometria sottostante. Ciò ha evidenziato gli effetti dell'acqua in modo che potessimo spiegarli meglio nell'analisi.

Selezionando tutte le increspature come frame "wire", otteniamo:

Ora possiamo vedere chiaramente gli effetti dell'acqua lungo le sponde del fiume, così come intorno a rocce e ninfee.

Con il rendering e l'animazione normali, l'acqua appare così:

Fase di rendering 7: decalcomanie

Dopo aver applicato l'erba e l'acqua, aggiungiamo le decalcomanie: semplici elementi geometrici con una trama piatta che sono sovrapposti alla parte superiore del terreno, come l'indicatore della distanza della torretta nell'immagine qui sotto.

Rendering Fase 8: Percorsi speciali

Qui abbiamo a che fare con contorni più spessi abilitati tramite eventi del mouse o stati di attivazione speciali, come nel caso del contorno della torre nella figura seguente. Questo viene fatto più o meno allo stesso modo in cui abbiamo creato i contorni delle maglie scuoiate, ma qui sfociamo anche i contorni per renderli più spessi. Questa selezione è notevolmente ancora più forte, perché viene eseguita più avanti nel processo di rendering e può sovrapporsi agli effetti già applicati.

Rendering Fase 9: Particelle

La fase successiva è una delle più importanti: le particelle. Ho già scritto di particelle in questo articolo. Ogni incantesimo, buff ed effetto è un sistema di particelle che deve essere animato e aggiornato. La scena che stiamo guardando non ha tanta azione come, ad esempio, un combattimento a squadre 5v5, ma ha ancora molte particelle renderizzate.Se consideriamo solo le particelle (disabilitando l'intera scena di sfondo), otteniamo la seguente immagine:

Rendendo i triangoli che compongono le particelle con contorni viola (nessuna texture, solo geometria), otteniamo quanto segue:

Se disegniamo le particelle normalmente, otteniamo un aspetto più familiare.

Render pass 10: effetti di post-elaborazione

Quindi, le parti di base della scena sono già renderizzate e possiamo darle un po' più di "lucentezza". Questo viene fatto in due fasi. Innanzitutto, eseguiamo un passaggio anti-alias (AA). Aiuta a smussare i bordi frastagliati, rendendo l'intero fotogramma più nitido. In un'immagine statica, questo effetto è quasi impercettibile, ma aiuta notevolmente a eliminare lo "sfarfallio dei pixel" che può verificarsi quando si spostano i bordi ad alto contrasto sullo schermo. IN LOL utilizziamo l'algoritmo Fast Approximate Anti-Aliasing (FXAA).L'immagine a sinistra è il servitore prima di FXAA e quello a destra è dopo l'anti-alias. Nota come i bordi dell'oggetto sono smussati.

Dopo aver completato il passaggio FXAA, eseguiamo un passaggio gamma per regolare la luminosità della scena. Come ottimizzazione, abbiamo recentemente aggiunto un effetto di desaturazione dello schermo mortale al passaggio gamma, che elimina la necessità di sostituire tutti gli shader delle attuali mesh visibili per le varianti di morte che in precedenza erano state desaturate individualmente.

Fase di rendering 11: barre dei danni e della salute

Quindi eseguiamo il rendering di tutti gli indicatori di gioco: barre della salute, testo del danno, testo sullo schermo, nonché tutti gli effetti a schermo intero non post-elaborazione, come l'effetto del danno nell'immagine qui sotto.

Rendering Fase 12: Interfaccia

E infine, l'interfaccia utente viene renderizzata. Tutti i testi, le icone e gli oggetti vengono visualizzati sullo schermo come trame separate, sovrapponendo tutto ciò che si trova sotto di essi. Nel caso che abbiamo analizzato, ci sono voluti circa 1.000 triangoli per disegnare l'interfaccia: circa 300 per la minimappa e 700 per tutto il resto.

Mettere tutto insieme

E otteniamo una scena completamente renderizzata. L'intera scena contiene circa 200.000 triangoli, 90.000 dei quali sono usati per le particelle. 28 milioni di pixel vengono disegnati in 695 chiamate di estrazione. Affinché il gioco sia giocabile, tutto questo lavoro deve essere svolto il più rapidamente possibile. Per raggiungere 60 fotogrammi al secondo o più, tutte le fasi devono essere completate in meno di 16,66 millisecondi. E questi sono solo calcoli lato GPU: tutta la logica di gioco, l'elaborazione dell'input del giocatore, le collisioni, l'elaborazione di particelle, le animazioni e l'invio di comandi per il rendering devono essere eseguiti contemporaneamente anche nel processore centrale. Se stai giocando a 300 fps, tutto accade in meno di 3,3 millisecondi!

Perché refactoring di un renderer?

Ora dovresti essere consapevole delle complessità coinvolte nel rendering di un singolo frame del gioco. Lega. Ma questo è solo il lato dell'output dei dati: quello che vedi sullo schermo è il risultato di migliaia di chiamate di funzioni al nostro motore di rendering. È in continua evoluzione ed evoluzione per adattarsi meglio alle odierne esigenze di rendering. Ciò ha comportato la coesistenza di diverse forme di rendering del codice nella base di codice di LoL perché dobbiamo tenere conto del nuovo hardware e supportare il vecchio hardware. Ad esempio, la Landa dell'Evocatore ha un rendering leggermente diverso rispetto a Howling Abyss e Twisted Treeline. Ci sono parti del renderer rimaste dalle versioni precedenti Lega e parti che devono ancora raggiungere il loro pieno potenziale. L'obiettivo del Render Strike Team è quello di prendere tutto il codice di rendering e rifattorizzarlo in modo che tutto il rendering avvenga attraverso la stessa interfaccia. Se facciamo bene il nostro lavoro, i giocatori non noteranno affatto la differenza (tranne forse un leggero aumento di velocità in vari punti). Ma dopo che avremo finito, avremo una grande opportunità di apportare modifiche simultanee a tutte le modalità di gioco durante il rendering di Aggiungi tag 02 ottobreChe cos'è il rendering (rendering)

Render (Rendering) è il processo di creazione di un'immagine finale o di una sequenza di immagini da dati 2D o 3D. Questo processo avviene tramite programmi informatici ed è spesso accompagnato da difficili calcoli tecnici che ricadono sulla potenza di calcolo del computer o sui suoi singoli componenti.

Il processo di rendering è presente in un modo o nell'altro in varie aree dell'attività professionale, che si tratti dell'industria cinematografica, dell'industria dei videogiochi o del video blog. Spesso, il rendering è l'ultima o la penultima fase del lavoro sul progetto, dopo di che il lavoro è considerato completato o necessita di una piccola rielaborazione. Vale anche la pena notare che spesso non il processo di rendering stesso è chiamato rendering, ma piuttosto una fase già completata di questo processo o il suo risultato finale.

le parole "Render".

La parola Render (Rendering) è anglicismo, che viene spesso tradotto in russo con la parola " Visualizzazione”.

Che cos'è il rendering in 3D?

Molto spesso, quando parliamo di rendering, intendiamo il rendering in grafica 3D. Va subito notato che infatti nel rendering 3D non ci sono le tre dimensioni in quanto tali, che spesso possiamo vedere in una sala cinematografica indossando occhiali speciali. Il prefisso "3D" nel nome ci dice piuttosto come creare un rendering, che utilizza oggetti tridimensionali creati in programmi per computer per la modellazione 3D. In poche parole, alla fine, otteniamo comunque un'immagine 2D o la loro sequenza (video) che è stata creata (renderizzata) sulla base di un modello o scena 3D.

Il rendering è una delle fasi tecnicamente più difficili nel lavorare con la grafica 3D. Per spiegare questa operazione in termini semplici, possiamo tracciare un'analogia con il lavoro dei fotografi. Affinché la foto appaia in tutto il suo splendore, il fotografo deve eseguire alcuni passaggi tecnici, ad esempio lo sviluppo della pellicola o la stampa su una stampante. Approssimativamente le stesse fasi tecniche sono gravate dagli artisti 3d che, per creare l'immagine finale, passano attraverso la fase di impostazione del rendering e il processo di rendering stesso.

Costruzione dell'immagine.

Come accennato in precedenza, il rendering è una delle fasi tecniche più difficili, perché durante il rendering ci sono complessi calcoli matematici eseguiti dal motore di rendering. In questa fase, il motore traduce i dati matematici sulla scena nell'immagine 2D finale. Durante il processo, la geometria 3D, le trame e i dati sulla luce della scena vengono convertiti in informazioni combinate sul valore del colore di ciascun pixel in un'immagine 2D. In altre parole, il motore, in base ai dati in suo possesso, calcola di che colore deve essere dipinto ogni pixel dell'immagine per ottenere un'immagine complessa, bella e completa.

Tipi di rendering di base:

A livello globale, ci sono due tipi principali di rendering, le differenze principali sono la velocità con cui l'immagine viene renderizzata e finalizzata, nonché la qualità dell'immagine.

Che cos'è il rendering in tempo reale?

Il rendering in tempo reale è spesso ampiamente utilizzato nei giochi e nella grafica interattiva, in cui l'immagine deve essere renderizzata alla massima velocità possibile e visualizzata istantaneamente nella sua forma finale sul monitor.

Poiché il fattore chiave in questo tipo di rendering è l'interattività dell'utente, l'immagine deve essere renderizzata senza indugio e quasi in tempo reale, poiché è impossibile prevedere con precisione il comportamento del giocatore e come interagirà con il gioco o con il scena interattiva. Affinché una scena o un gioco interattivo funzionino senza intoppi e lentezza, il motore 3D deve renderizzare l'immagine a una velocità di almeno 20-25 fotogrammi al secondo. Se la velocità di rendering è inferiore a 20 fotogrammi, l'utente si sentirà a disagio dalla scena, guardando scatti e rallentamenti.

Il processo di ottimizzazione gioca un ruolo importante nella creazione di un rendering fluido nei giochi e nelle scene interattive. Per ottenere la velocità di rendering desiderata, gli sviluppatori utilizzano vari trucchi per ridurre il carico sul motore di rendering, cercando di ridurre il numero forzato di rendering. Ciò include la riduzione della qualità dei modelli 3D e delle trame, nonché la scrittura di alcune informazioni sulla luce e sui rilievi su mappe di trama pre-cotte. Vale anche la pena notare che la parte principale del carico durante il rendering in tempo reale ricade su apparecchiature grafiche specializzate (scheda video -GPU), che riduce il carico sull'unità di elaborazione centrale (CPU) e libera la sua potenza di calcolo per altre attività .

Che cos'è il Prerender?

Il pre-rendering viene utilizzato quando la velocità non è una priorità e non è necessaria l'interattività. Questo tipo di renderer viene utilizzato più spesso nell'industria cinematografica, quando si lavora con animazioni ed effetti visivi complessi, nonché dove sono necessari fotorealismo e una qualità dell'immagine molto elevata.

A differenza del rendering in tempo reale, in cui il carico principale ricade sulle schede grafiche (GPU) Nel pre-rendering, il carico ricade sull'unità di elaborazione centrale (CPU) e la velocità di rendering dipende dal numero di core, dal multithreading e dalle prestazioni del processore.

Accade spesso che il tempo di rendering di un fotogramma richieda diverse ore o addirittura diversi giorni. In questo caso, gli artisti 3D hanno bisogno di poca o nessuna ottimizzazione e possono utilizzare modelli 3D della massima qualità e mappe di texture ad altissima risoluzione. Di conseguenza, l'immagine è molto migliore e più fotorealistica rispetto al rendering in tempo reale.

Software di rendering.

Ora, sul mercato è disponibile un gran numero di motori di rendering, che differiscono tra loro per velocità, qualità dell'immagine e facilità d'uso.

Di norma, i motori di rendering sono integrati in grandi programmi di grafica 3D e hanno un enorme potenziale. Tra i programmi 3D (pacchetti) più popolari ci sono software come:

- 3ds massimo;

- Maya;

- miscelatore;

- cinema 4d e così via.

Molti di questi pacchetti 3D hanno motori di rendering già inclusi. Ad esempio, il motore di rendering Mental Ray è presente nel pacchetto 3Ds Max. Inoltre, quasi tutti i motori di rendering più diffusi possono essere collegati ai pacchetti 3D più noti. I motori di rendering più diffusi includono:

- raggi V;

- raggio mentale;

- renderer corona e così via.

Vorrei notare che, sebbene il processo di rendering abbia errori matematici molto complessi, gli sviluppatori di programmi di rendering 3D stanno cercando in tutti i modi di salvare gli artisti 3D dal lavorare con la matematica complessa del programma di rendering sottostante. Cercano di fornire impostazioni di rendering parametrico relativamente facili da capire, nonché set e librerie di materiali e luci.

Molti motori di rendering hanno trovato fama in alcune aree di lavoro con la grafica 3D. Quindi, ad esempio, "V-ray" è molto popolare tra i renderer di architettura, grazie alla presenza di un gran numero di materiali per la visualizzazione architettonica e, in generale, alla buona qualità del rendering.

metodi di visualizzazione.

La maggior parte dei motori di rendering utilizza tre metodi di calcolo principali. Ognuno di essi ha sia vantaggi che svantaggi, ma tutti e tre i metodi hanno il diritto di essere utilizzati in determinate situazioni.

1. Linea di scansione (linea di scansione).

Il rendering della linea di scansione è la scelta di coloro che privilegiano la velocità rispetto alla qualità. Grazie alla sua velocità, questo tipo di rendering viene spesso utilizzato nei videogiochi e nelle scene interattive, nonché nelle finestre di vari pacchetti 3D. Con una moderna scheda video, questo tipo di renderer può produrre un'immagine in tempo reale stabile e uniforme con una frequenza di 30 fotogrammi al secondo e oltre.

Algoritmo di lavoro:

Invece di eseguire il rendering "pixel per pixel", l'algoritmo del renderer "scanline" è che determina la superficie visibile nella grafica 3D e, lavorando sul principio "riga per riga", prima ordina i poligoni necessari per il rendering in base alla Y più alta coordinata, che appartiene a un determinato poligono, dopodiché ogni riga dell'immagine viene calcolata intersecando la riga con il poligono più vicino alla telecamera. I poligoni non più visibili vengono rimossi man mano che ci si sposta da una riga all'altra.

Il vantaggio di questo algoritmo è che non è necessario trasferire le coordinate di ciascun vertice dalla memoria principale a quella di lavoro e vengono trasmesse le coordinate dei soli vertici che cadono nella zona di visibilità e rendering.

2. Raytrace (raytrace).

Questo tipo di rendering è stato creato per coloro che vogliono ottenere un'immagine con la massima qualità e un disegno dettagliato. Il rendering di questo particolare tipo è molto popolare tra gli appassionati di fotorealismo e vale la pena notare che non è casuale. Abbastanza spesso, con l'aiuto del rendering del ray trace, possiamo vedere scatti incredibilmente realistici della natura e dell'architettura, che non tutti possono distinguere dalla fotografia, inoltre, è spesso il metodo del ray trace che viene utilizzato per lavorare sulla grafica nei trailer CG o film.

Sfortunatamente, per motivi di qualità, questo algoritmo di rendering è molto lento e non può ancora essere utilizzato nella grafica in tempo reale.

Algoritmo di lavoro:

L'idea dell'algoritmo Raytrace è che per ogni pixel dello schermo condizionale, uno o più raggi vengono tracciati dalla fotocamera all'oggetto tridimensionale più vicino. Il raggio di luce passa quindi attraverso un certo numero di rimbalzi, che possono includere riflessi o rifrazioni a seconda dei materiali della scena. Il colore di ciascun pixel viene calcolato algoritmicamente in base all'interazione del raggio di luce con gli oggetti nel suo percorso tracciato.

Metodo Raycast.

L'algoritmo funziona sulla base del "casting" dei raggi come se provenisse dagli occhi dell'osservatore, attraverso ogni pixel dello schermo e trovando l'oggetto più vicino che blocca il percorso di tale raggio. Usando le proprietà dell'oggetto, il suo materiale e l'illuminazione della scena, otteniamo il colore dei pixel desiderato.

Capita spesso che il “metodo del ray tracing” (raytrace) venga confuso con il metodo del “ray casting”. Ma in effetti, il "raycasting" (il metodo per lanciare un raggio) è in realtà un metodo semplificato di "raytrace", in cui non c'è ulteriore elaborazione dei raggi rimbalzati o rotti, ma viene calcolata solo la prima superficie nel percorso del raggio .

3. Radiosità.

Invece di un "metodo di ray tracing", il rendering in questo metodo funziona indipendentemente dalla fotocamera ed è orientato agli oggetti, a differenza del metodo "pixel per pixel". La funzione principale della "radiosità" è quella di simulare più accuratamente il colore della superficie tenendo conto dell'illuminazione indiretta (rimbalzo della luce diffusa).

I vantaggi della "radiosità" sono ombre sfumate morbide e riflessi di colore sull'oggetto, provenienti da oggetti vicini dai colori vivaci.

La pratica di utilizzare insieme il metodo Radiosity e Raytrace per ottenere i rendering più impressionanti e fotorealistici è piuttosto popolare.

Che cos'è il rendering video?

A volte, l'espressione "rendering" viene utilizzata non solo quando si lavora con la computer grafica 3D, ma anche quando si lavora con file video. Il processo di rendering video inizia quando l'utente dell'editor video ha finito di lavorare sul file video, impostato tutti i parametri di cui ha bisogno, colonne sonore ed effetti visivi. In effetti, non resta che combinare tutto ciò che è stato fatto in un unico file video. Questo processo può essere paragonato al lavoro di un programmatore, quando ha scritto il codice, dopodiché non resta che compilare tutto il codice in un programma funzionante.

Come un designer 3D e un utente di un editor video, il processo di rendering è automatico e senza l'intervento dell'utente. Tutto ciò che serve è impostare alcuni parametri prima di iniziare.

La velocità di rendering video dipende dalla durata e dalla qualità richieste per l'output. Fondamentalmente, la maggior parte del calcolo ricade sulla potenza del processore centrale, quindi la velocità di rendering video dipende dalle sue prestazioni.

Categorie: , // da