این موضوع یکی از موضوعات محوری در نظریه اطلاعات است. این قابلیت های محدود کننده کانال های ارتباطی را برای انتقال اطلاعات در نظر می گیرد، ویژگی های کانال هایی را که بر این قابلیت ها تأثیر می گذارند را تعیین می کند، به طور کلی قابلیت های محدود کننده کدگذاری را که حداکثر ایمنی نویز و مقدار اطلاعات ارسال شده را فراهم می کند، بررسی می کند.

تعاریف:

1. نرخ انتقال اطلاعاتمیانگین مقدار اطلاعاتی است که از طریق کانال در واحد زمان منتقل می شود.

در مورد کانال بدون نویز، این سرعت برابر است با V تا *H به، جایی که V بهتعداد نمادهای ارسال شده از طریق کانال در واحد زمان است، H بهمیانگین آنتروپی یک نماد پیام در ورودی و خروجی کانال است.

2. عملکرد منبعمیانگین نرخ دریافت اطلاعات از منبع پیام است.

عملکرد منبع با فرمول پیدا می شود V و *H و، جایی که V وتعداد نمادهای تولید شده توسط منبع در واحد زمان است، H ومیانگین آنتروپی یک نماد پیام در خروجی منبع است.

ظرفیت کانال ارتباطی- حداکثر نرخ انتقال اطلاعات ممکن برای این کانال. به آن اشاره خواهیم کرد ج به.

ما به یکی دیگر از ویژگی های مهم کانال توجه می کنیم - حداکثر نرخ نماد V تا حداکثراز طریق او او همیشه محدود است. بنابراین، حداکثر سرعت انتقال اطلاعات با استفاده از حداکثر نرخ نماد و حداکثر میانگین آنتروپی به دست می آید V تا حداکثرشخصیت منتقل شده قبلاً ثابت شده بود که حداکثر آنتروپی متوسط به ازای هر یک نماد با احتمال و استقلال مساوی از وقوع آنها به دست می آید.

از آنجایی که منبع اطلاعات لزوماً نمادهایی با این ویژگی ها را خروجی نمی کند، آنها باید برای دستیابی به کارآمدترین استفاده از کانال کدگذاری شوند. پیش از این، هنگام مطالعه کدگذاری کارآمد، ثابت شد که کدگذاری کارآمدی است که پس از رمزگذاری، کاراکترهایی را با پارامترهای مورد نیاز ارائه می دهد. آنتروپی نمادهای الفبای ثانویه در نتیجه چنین رمزگذاری هنگام رمزگذاری بلوک های بی نهایت بزرگ از توالی اطلاعات در حد برابر است با چوب 2 متر، جایی که مترحجم الفبای ثانویه استفاده شده در خروجی رمزگذار است.

با توجه به این: C تا \u003d V تا * H max \u003d V تا * log 2 m.

اگر m=2(کد باینری برای رمزگذاری استفاده می شود)، سپس آنتروپی یک کاراکتر در خروجی رمزگذار برابر با 1 خواهد بود، یعنی. هر نماد از کد موثر باینری حاوی 1 بیت اطلاعات است و خود نمادها به همان اندازه محتمل و از نظر آماری مستقل خواهند بود.

در این مورد C تا \u003d V به.

هنگام انتقال اطلاعات از طریق یک کانال ارتباطی، آنها تلاش می کنند تا کارآمدترین (از نظر میزان اطلاعات ارسال شده) از آن استفاده کنند.

اجازه دهید الزامات منبع اطلاعات را پیدا کنیم که تحت آن حداکثر سرعت انتقال اطلاعات از طریق کانال امکان پذیر است.

ما منبع اطلاعات را با پارامترها شرح خواهیم داد V وو H و. فرض کنید هیچ نویز در کانال ارتباطی وجود ندارد. کانال ارتباطی با پهنای باند و حجم آن توصیف می شود مترالفبا.

از آنجایی که هیچ نویز در کانال وجود ندارد، اطلاعات در حین انتقال از طریق آن تحریف یا از بین نمی روند. بنابراین، نرخ انتقال اطلاعات در خروجی منبع V و *H وو خروجی کانال مطابقت خواهد داشت. کارآمدترین استفاده از کانال به گونه ای خواهد بود که عملکرد منبع برابر با پهنای باند کانال باشد:

C تا \u003d V تا حداکثر * log 2 m \u003d V و * H و.

بنابراین، اگر میانگین آنتروپی یک نماد از پیامی که از خروجی منبع می آید مشخص باشد، در صورتی می توان به کارآمدترین استفاده از کانال دست یافت که نرخ رسیدن این نمادها از منبع مطابق با فرمول انتخاب شود. : V و \u003d V تا حداکثر * log 2 m / H ویا V و \u003d V تا حداکثر / H وبا استفاده از رایج ترین رمزگذاری باینری استفاده می شود.

توجه داشته باشید که این فرمول استفاده از کدگذاری کارآمد اطلاعات از منبع را قبل از انتقال بدون تداخل (نویز) به کانال ارتباطی فرض می کند.

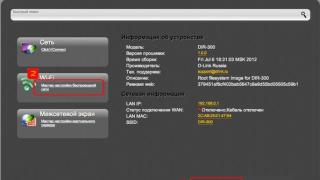

مدل زیر از یک کانال ارتباطی پر سر و صدا را در نظر بگیرید (شکل 4.4):

برنج. 4.4. مدل کانال ارتباطی پر سر و صدا.

با توجه به نوع سیگنال های ارسال شده از طریق کانال، کانال های ارتباطی گسسته و پیوسته متمایز می شوند.

مهمترین ویژگی یک کانال آن است پهنای باند، به عنوان بالاترین نرخ انتقال اطلاعات از طریق آن تعریف می شود. پهنای باند یک کانال گسسته را می توان به عنوان مثال با استفاده از فرمول زیر محاسبه کرد:

C \u003d V k * I m a x ,

جایی که Vk- میزان انتقال حروف الفبا از طریق کانال؛

من یک x هستم- حداکثر مقدار ممکن اطلاعات به ازای هر نماد ارسال شده از طریق کانال.

مقدار اطلاعات به ازای هر 1 نماد منتقل شده از طریق کانال به آنتروپی (درجه عدم قطعیت در به دست آوردن نماد) در ورودی و خروجی کانال بستگی دارد. طبق معیار شانون

I = H پیشینی - H پسین = H(X) – H(X/Y) .

اینجا H پیشینی = H(X)و H خلفی = H(X/Y)- آنتروپی شرطی که عدم قطعیت در مورد نماد ارسال شده به خروجی کانال را مشخص می کند ایکسبا شخصیت پذیرفته شده Yدر خروجی وجود این عدم قطعیت نتیجه عمل روی نماد نویز است که از طریق کانال منتقل می شود. H(X/Y) -ویژگی کانال

پایان کار -

این موضوع متعلق به:

تئوری اطلاعات و کدگذاری

دانشگاه دولتی سوچی.. گردشگری و کسب و کار تفریحی.. دانشکده فناوری اطلاعات و ریاضیات..

اگر به مطالب اضافی در مورد این موضوع نیاز دارید یا آنچه را که به دنبال آن بودید پیدا نکردید، توصیه می کنیم از جستجو در پایگاه داده آثار ما استفاده کنید:

با مطالب دریافتی چه خواهیم کرد:

اگر این مطالب برای شما مفید بود، می توانید آن را در صفحه خود در شبکه های اجتماعی ذخیره کنید:

| توییت |

تمامی موضوعات این بخش:

دوره سخنرانی

سازماندهی مؤثر تبادل اطلاعات به عنوان شرطی برای فعالیتهای عملی موفق افراد اهمیت فزاینده ای پیدا می کند. مقدار اطلاعات لازم برای عملکرد عادی مدرن

تعریف مفهوم اطلاعات

کلمه اطلاعات از لاتین informare گرفته شده است - به تصویر کشیدن، ساختن مفهومی در مورد چیزی، اطلاع رسانی. اطلاعات همراه با ماده و انرژی اولیه است

مراحل گردش اطلاعات

سیستم کنترل شامل یک شیء کنترلی، مجموعه ای از ابزارهای فنی متشکل از یک کامپیوتر، دستگاه های ورودی-خروجی و ذخیره سازی اطلاعات موجود در آن، دستگاه های جمع آوری انتقال است.

برخی از تعاریف

دادهها یا سیگنالهایی که در توالیهای معینی سازماندهی شدهاند، اطلاعات را حمل میکنند نه به این دلیل که اشیاء دنیای واقعی را تکرار میکنند، بلکه بر اساس قرارداد اجتماعی در مورد رمزگذاری، یعنی. یکی

اقدامات اطلاعاتی

قبل از پرداختن به معیارهای اطلاعاتی به این نکته اشاره می کنیم که منابع اطلاعاتی و پیام هایی که ایجاد می کنند به دو دسته گسسته و پیوسته تقسیم می شوند. پیام های گسسته به طور متناهی تشکیل شده اند

اندازه گیری هندسی

تعیین مقدار اطلاعات با روش هندسی به اندازه گیری طول خط، مساحت یا حجم مدل هندسی حامل اطلاعات یا پیام معین کاهش می یابد. با ابعاد هندسی

اندازه گیری افزایشی (میزان اندازه گیری هارتلی)

اندازه گیری افزایشی را می توان به عنوان یک معیار ترکیبی راحت تر برای تعدادی از کاربردها در نظر گرفت. شهود ما در مورد اطلاعات نشان می دهد که مقدار اطلاعات با افزایش می یابد

آنتروپی و خواص آن

انواع مختلفی از معیارهای آماری اطلاعات وجود دارد. در ادامه تنها یکی از آنها یعنی اندازه شانون را بررسی خواهیم کرد. اندازه گیری شانون از مقدار اطلاعات ارتباط نزدیکی با مفهوم دارد

آنتروپی و میانگین آنتروپی یک رویداد ساده

اجازه دهید مفهوم آنتروپی را در نسخه های مختلف با جزئیات بیشتری در نظر بگیریم، زیرا در نظریه اطلاعات شانون استفاده می شود. آنتروپی معیاری برای عدم قطعیت برخی از تجربیات است. در ساده ترین حالت، آن است

روش ضریب لاگرانژ استخراج فرمول برای مقدار متوسط آنتروپی در هر حرف پیام آنتروپی یک رویداد پیچیده متشکل از چندین رویداد وابسته افزونگی پیام محتوای اطلاعات مفید بودن اطلاعات آنتروپی پویا آنتروپی پیام های پیوسته مورد اول (مقادیر مقادیر زیر با فاصله محدود می شود) حالت دوم (واریانس و انتظار ریاضی مقدار بعدی داده شده است) کوانتیزاسیون سیگنال انواع گسسته سازی (کوانتیزاسیون) معیارهای دقت نمایش یک سیگنال کوانتیزه عناصر نظریه طیفی تعمیم یافته سیگنال ها در مورد استفاده عملی از قضیه Kotelnikov انتخاب دوره نمونه برداری (کوانتیزاسیون زمانی) با توجه به معیار بیشترین انحراف درونیابی با استفاده از چند جمله ای لاگرانژ تخمین حداکثر مقدار خطا در به دست آوردن تابع بازتولید بر اساس چند جمله ای لاگرانژ تعمیم به مورد استفاده از چند جمله ای های لاگرانژ با نظم دلخواه انتخاب فاصله نمونه برداری با معیار انحراف معیار کوانتیزاسیون سطح بهینه محاسبه بهینه غیر یکنواخت به معنای حداقل خطای واریانس مقیاس کوانتیزاسیون مفاهیم و تعاریف کلی. اهداف رمزگذاری عناصر نظریه کدگذاری نابرابری کرافت قضیه 2. قضیه 3. قضیه حداقل میانگین طول یک کلمه رمز برای کدگذاری بلوک (قضیه 4) کدهای غیر یکنواخت بهینه لم 1. در مورد وجود یک کد بهینه با طول کلمات رمز یکسان از دو حرف رمزگذاری شده با حداقل احتمال لم 2. در مورد بهینه بودن کد پیشوند یک مجموعه غیر کاهش یافته اگر کد پیشوند مجموعه کاهش یافته بهینه باشد

ویژگی های کدهای کارآمد کدنویسی تصحیح کننده نویز ساده ترین مدل های کانال های ارتباطی دیجیتال با تداخل محاسبه احتمال تحریف یک کلمه رمز در DSMK اصول کلی برای استفاده از افزونگی مرز همینگ افزونگی کدهای تصحیح خطا کدهای خط تعیین تعداد ارقام اضافی m ساخت ماتریس مولد سفارش رمزگذاری دستور رمزگشایی کدهای چرخه ای باینری برخی از ویژگی های کدهای چرخه ای ساخت یک کد با توانایی اصلاحی معین شرح ماتریسی کدهای چرخه ای انتخاب یک چند جمله ای مولد انواع کانال های انتقال اطلاعات پهنای باند یک کانال ارتباطی گسسته با نویز توالی های معمولی و خواص آنها قضیه اصلی شانون برای یک کانال گسسته با نویز بحث در مورد قضیه اصلی شانون برای یک کانال نویزدار خروجی یک کانال پیوسته در حضور نویز افزودنی مرحله 2. وارد کردن فایل های متنی در صفحه گسترده اکسل، شکستن هر خط از متن به کاراکترهای جداگانه مرحله 4. میانگین آنتروپی در هر 1 حرف از پیام را بیابید مرحله 8. بیایید یک گزارش پیشرفت بنویسیم که تمام محاسبات و نحوه انجام آنها را توضیح دهد. در مورد نتایج نظر دهید اتصال امکان استفاده از توابع غیر استاندارد ایجاد یک تابع سفارشی ضبط صدا و آماده سازی سیگنال داده های متنی را به اکسل وارد کنید کوانتیزاسیون سطح به جایگزینی مقدار سیگنال اصلی با سطح مرحله ای که این مقدار در آن قرار می گیرد کاهش می یابد. کدهای هافمن این روند تا زمانی تکرار می شود که در هر زیرگروه فقط یک حرف باقی بماند. پارامترهای کارایی کدهای بهینه ویژگی های کدهای کارآمد تکمیل کار ساخت ماتریس مولد سفارش رمزگذاری دستور رمزگشایی تکمیل کار در هر سیستم ارتباطی، اطلاعات از طریق یک کانال منتقل می شود. نرخ انتقال اطلاعات در § 2.9 تعریف شده است. این سرعت نه تنها به خود کانال بستگی دارد، بلکه به ویژگی های سیگنال اعمال شده به ورودی آن نیز بستگی دارد و بنابراین نمی تواند کانال را به عنوان وسیله ای برای انتقال اطلاعات مشخص کند. بیایید سعی کنیم راهی برای ارزیابی توانایی کانال در انتقال اطلاعات پیدا کنیم. اجازه دهید ابتدا یک کانال مجزا را در نظر بگیریم که از طریق آن نمادهای الفبا در واحد زمان ارسال می شوند.در حین انتقال هر نماد، میانگین مقدار اطلاعات از کانال عبور می کند [شکل را ببینید. (2.135) و (2.140)]: که در آن نمادهای تصادفی در ورودی و خروجی کانال قرار دارند. از چهار آنتروپی که در اینجا ظاهر می شود، اطلاعات ذاتی نماد ارسالی، توسط منبع سیگنال گسسته تعیین می شود و به ویژگی های کانال بستگی ندارد. سه آنتروپی باقی مانده عموماً به منبع سیگنال و کانال بستگی دارد. اجازه دهید تصور کنیم که نمادهایی از منابع مختلف که با توزیعهای احتمال متفاوت مشخص میشوند، میتوانند به ورودی کانال وارد شوند (اما، البته، برای مقادیر یکسان. برای هر منبع، مقدار اطلاعات ارسال شده از طریق کانال مقدار خاص خود را میگیرد. حداکثر مقدار اطلاعات منتقل شده، برگرفته از انواع مختلف منابع سیگنال ورودی، خود کانال را مشخص می کند و به آن پهنای باند کانال می گویند. در هر شخصیت که در آن بیشینه سازی روی همه توزیع های احتمال چند متغیره انجام می شود. همچنین می توانید توان عملیاتی کانال C را در واحد زمان (ثانیه) تعیین کنید: آخرین برابری از افزایش آنتروپی ناشی می شود. در آینده، هر جا که به طور خاص بیان نشده باشد، ما گذردهی در ثانیه را به عنوان توان عملیاتی درک خواهیم کرد. به عنوان مثال، ظرفیت یک کانال بدون حافظه متقارن را محاسبه می کنیم که احتمالات انتقال برای آن با فرمول (3.36) داده شده است. طبق (3.52) و (3.53) مقدار در این مورد به راحتی محاسبه می شود، زیرا احتمال انتقال شرطی تنها دو مقدار را می گیرد: اگر اولی از این مقادیر با احتمال و دومی با احتمال K رخ دهد. همچنین، از آنجایی که یک کانال بدون حافظه در نظر گرفته می شود، نتایج دریافت می شود. نمادهای فردی مستقل از یکدیگر هستند. از همین رو بنابراین، به توزیع احتمال B بستگی ندارد، بلکه تنها با احتمالات انتقال کانال تعیین می شود. این ویژگی برای همه مدل های کانال با نویز افزودنی حفظ می شود. با جایگزینی (3.56) به (3.55)، به دست می آوریم از آنجایی که در سمت راست فقط عبارت به توزیع احتمال بستگی دارد، لازم است آن را به حداکثر برسانیم. حداکثر مقدار مطابق (2.123) برابر است و زمانی محقق می شود که همه نمادهای دریافتی به یک اندازه محتمل و مستقل از یکدیگر باشند. اگر نمادهای ورودی به یک اندازه محتمل و مستقل باشند، به راحتی می توان تأیید کرد که این شرط برآورده می شود، زیرا در عین حال و از این رو توان عملیاتی در ثانیه است برای یک کانال متقارن باینری، توان عملیاتی بر حسب واحد باینری در ثانیه وابستگی به مطابق (3.59) در شکل نشان داده شده است. 3.9. ظرفیت یک کانال باینری چه زمانی است، زیرا با چنین احتمال خطایی می توان دنباله ای از نمادهای باینری خروجی را بدون ارسال سیگنال روی کانال، اما با انتخاب تصادفی آنها به دست آورد (مثلاً با توجه به نتایج پرتاب یک سکه)، یعنی زمانی که دنباله های خروجی و ورودی کانال مستقل هستند. این مورد را شکست کانال می نامند. این واقعیت که گذردهی برای at در کانال باینری مشابه برای (کانال بدون نویز) است با این واقعیت توضیح داده می شود که برای در آن برای معکوس کردن همه نمادهای خروجی کافی است (یعنی 0 را با 1 و 1 را با 0 جایگزین کنید). به منظور بازیابی صحیح سیگنال ورودی برنج. 3.9. وابستگی توان عملیاتی یک کانال متقارن باینری بدون حافظه به احتمال دریافت اشتباه یک نماد توان عملیاتی یک کانال پیوسته به روشی مشابه محاسبه می شود. مثلاً اجازه دهید کانال پهنای باند محدودی داشته باشد سپس سیگنالهای ورودی و خروجی کانال، طبق قضیه کوتلنیکف، با نمونههای گرفته شده در فواصل زمانی مشخص میشوند و بنابراین اطلاعاتی که برای مدتی از کانال عبور میکنند، تعیین میشوند. برابر است با مجموع مقادیر اطلاعات ارسال شده برای هر نمونه. ظرفیت کانال در هر نمونه در اینجا، متغیرهای تصادفی، مقطع فرآیندها در ورودی و خروجی کانال هستند، و حداکثر بر روی تمام سیگنالهای ورودی مجاز، یعنی بر روی همه توزیعها، گرفته میشود. توان عملیاتی C به عنوان مجموع مقادیر Сots بر روی تمام نمونه ها در هر ثانیه تعریف می شود. در این مورد، البته، آنتروپی های دیفرانسیل در (3.60) باید با در نظر گرفتن روابط احتمالی بین قرائت ها محاسبه شوند. به عنوان مثال، ظرفیت یک کانال پیوسته بدون حافظه با نویز گاوسی سفید افزودنی که پهنای باند پهنای باند دارد را در صورتی که میانگین توان سیگنال (پراکندگی از مقدار معینی تجاوز نکند) محاسبه کنیم، توان (واریانس) نویز در باند با نشان داده می شود نمونه سیگنال های ورودی و خروجی و همچنین نویز با برابری مرتبط هستند و از آنجایی که دارای توزیع نرمال با انتظار ریاضی صفر است، پس چگالی احتمال شرطی در ثابت و نیز نرمال خواهد بود - با انتظارات ریاضی و واریانس، اجازه دهید توان عملیاتی را در هر نمونه پیدا کنیم: بر اساس (2.152) آنتروپی دیفرانسیل توزیع نرمال به انتظارات ریاضی بستگی ندارد و برابر است بنابراین برای یافتن آن باید چگالی توزیعی را پیدا کنید که در آن از (3.61) حداکثر شود. متغیرهای تصادفی مستقل، داریم بنابراین، واریانس ثابت است، همانطور که داده شد. مطابق (2.153)، با یک واریانس ثابت، حداکثر آنتروپی دیفرانسیل با توزیع نرمال ارائه می شود. از (3.61) می توان دریافت که با توزیع یک بعدی نرمال، توزیع نیز نرمال خواهد بود و بنابراین، با چرخش به گذردهی C در ثانیه، توجه میکنیم که اطلاعات ارسال شده روی چندین نمونه زمانی که نمونههای سیگنال مستقل هستند حداکثر است. اگر سیگنال به گونهای انتخاب شود که چگالی طیفی آن در باند یکنواخت باشد، میتوان به این امر دست یافت. بنابراین، پهنای باند C (در هر ثانیه) را می توان با اضافه کردن پهنای باند (3.63) برای نمونه های مستقل پیدا کرد: اگر یک فرآیند گاوسی با چگالی طیفی یکنواخت در باند فرکانس (نویز شبه سفید) تحقق یابد. از فرمول (3.64) می توان دریافت که اگر قدرت سیگنال محدود نبود، پهنای باند بی نهایت خواهد بود. اگر نسبت سیگنال به نویز در کانال صفر باشد، پهنای باند صفر است. با افزایش این نسبت، به دلیل وابستگی لگاریتمی، توان عملیاتی به طور نامحدود، اما به کندی افزایش می یابد. رابطه (3.64) اغلب فرمول شانون نامیده می شود. این فرمول در تئوری اطلاعات مهم است، زیرا وابستگی توان عملیاتی کانال پیوسته در نظر گرفته شده را به مشخصات فنی آن مانند پهنای باند و نسبت سیگنال به نویز تعیین می کند. فرمول شانون امکان تبادل پهنای باند برای قدرت سیگنال و بالعکس را نشان می دهد. با این حال، از آنجایی که C به صورت خطی و طبق قانون لگاریتمی به آن بستگی دارد، معمولاً جبران کاهش احتمالی پهنای باند با افزایش قدرت سیگنال عملی نیست. تبادل معکوس قدرت سیگنال برای پهنای باند کارآمدتر است. کانال ارتباطی نشان داده شده در شکل را در نظر بگیرید. 5-1. یک سیگنال به انتهای فرستنده آن ارسال می شود x(t)، که در یک نویز مخدوش وارد ورودی گیرنده می شود n(t)فرم y(t)[L. 47، 53]. اجازه دهید مفهوم ظرفیت کانال ارتباطی را معرفی کنیم. پهنای باند کانال ارتباطی به عنوان حداکثر مقدار اطلاعات نسبی سیگنال خروجی نسبت به ورودی تعریف می شود: جایی که من (x، y)- اطلاعات نسبی داده شده با فرمول (7-8)، و همه سیگنال ها به عنوان سیگنال های گسسته معادل در نظر گرفته می شوند (شکل 7-1)، به طوری که گاهی اوقات ارزش جایی که N=2f c t 0. اگر قرائت ها مستقل باشند، پس V=I 1 (x, y). بدیهی است که به کمک کمیت Vپهنای باند کانال ارتباطی را می توان با فرمول تعیین کرد برای آنتروپی نویز می توانیم بنویسیم: Н(n)=2f c t 0 H 1 (n)، آنتروپی نویز در هر نمونه برای نویز معمولی. فرمول های مشابهی را می توان برای سیگنال های معمولی نوشت ایکسو y. فرمول (7-10) برای واحد مرجع می تواند به صورت نوشته شود معنای این تعریف باید روشن شود. توجه داشته باشید که حداکثر در اینجا بر روی مجموعه توزیع احتمال سیگنال های ورودی با نویز ثابت گرفته می شود که فرض می شود داده شده است. در یک مورد خاص، این مجموعه از توزیع ها ممکن است از یک توزیع نرمال تشکیل شده باشد، همانطور که اغلب فرض می شود. اگر ظرفیت یک کانال ارتباطی بیشتر از کانال دیگر باشد (С 1 > С 2) در شرایط یکسان باقیمانده، از نظر فیزیکی این بدان معنی است که در حالت اول چگالی مشترک توزیع احتمال سیگنال های ورودی و خروجی بیشتر از در دوم، از آنجایی که با استفاده از فرمول (7-11) به راحتی می توان دریافت که توان عملیاتی عمدتاً توسط مقدار چگالی توزیع احتمال مشترک تعیین می شود. اگر اطلاعات نسبی (یا آنتروپی) سیگنال خروجی نسبت به ورودی بیشتر باشد، کانال ظرفیت بیشتری دارد. واضح است که اگر نویز افزایش یابد، توان عملیاتی کاهش می یابد. اگر ارتباط احتمالی بین سیگنال های خروجی و ورودی ناپدید شود، پس p(x,y)=p(x)p(y) و در فرمول (7-11)، لگاریتم و در نتیجه توان عملیاتی صفر می شود. مورد دیگر زمانی که p(x,y)=p(x|y)p(y) به صفر تمایل دارد، نیاز به بررسی دقیق دارد، زیرا log p(x, y)تمایل به - ∞ دارد. اگر p(y) → 0، سپس استدلال را می توان به صورت زیر ادامه داد. از آنجایی که احتمال ظهور سیگنال خروجی به صفر میل می کند، می توانیم فرض کنیم که احتمال ظهور سیگنال ایکسبستگی ندارد y، یعنی p(x|y)=p(x) در این مورد، توان عملیاتی صفر است، که با تفسیر فیزیکی مطابقت دارد، یعنی اگر سیگنالی وجود نداشته باشد [و نه مفید باشد. x(t)، بدون سر و صدا n(t)]، که به این معنی است که در کانال "پریز" (شکستگی) وجود دارد. در سایر موارد، توان عملیاتی غیر صفر است. طبیعی است که پهنای باند کانال ارتباطی را طوری تعیین کنیم که به سیگنال ورودی وابسته نباشد. برای این، یک عملیات بیشینه سازی معرفی شده است که مطابق با خواص شدید آنتروپی، اغلب سیگنال ورودی را با قانون توزیع نرمال تعیین می کند. بیایید نشان دهیم که اگر x(t)و n(t)مستقل و y(t)=x(t)+n(t)، آن I(x,y)=H(y)-H(n)، (7-12) جایی که H(y)و H(n)آنتروپی های دیفرانسیل سیگنال دریافتی و نویز هستند. شرط (7-12) به معنای خطی بودن کانال ارتباطی است به این معنا که نویز به سادگی به عنوان یک اصطلاح به سیگنال اضافه می شود. مستقیماً از I(x,y)=H(x)-H(x|y)=H(y)-H(y|x). زیرا ایکسو nپس از نظر آماری مستقل هستند با جایگزینی این نسبت به نسبت قبلی، (7-12) به دست می آید. بدیهی است که اگر نویز افزایشی باشد و به سیگنال ورودی بستگی نداشته باشد، حداکثر سرعت انتقال پیام از طریق کانال ارتباطی (حداکثر توان عملیاتی) زمانی حاصل می شود که maxH(y)، زیرا یک کانال ارتباطی گاوسی را بر اساس مفروضات زیر در نظر بگیرید: پهنای باند کانال توسط فرکانس محدود می شود. f c; نویز کانال - سفید معمولی با توان متوسط در واحد پهنای باند S n = S n 2; متوسط قدرت سیگنال مفید R x; سیگنال و نویز از نظر آماری مستقل هستند. سیگنال خروجی برابر است با مجموع سیگنال مفید و نویز. بدیهی است که مطابق با فرمول (7-4)، توان عملیاتی چنین کانالی به شرح زیر تعیین می شود H(n)=Flog2πeS n f c. (7-14) از آنجایی که سیگنال و نویز از نظر آماری مستقل هستند، با یکدیگر همبستگی ندارند، بنابراین میانگین توان سیگنال کل P y \u003d P x + S n f c \u003d P x + P n مطابق با فرمول (7-13)، لازم است حداکثر آنتروپی سیگنال را پیدا کنید y(t)در هر نمونه با توان متوسط معین با توجه به خواص شدید آنتروپی (نگاه کنید به فصل 6)، سیگنال y(t)باید به طور معمول توزیع شود. نویز سفید در باند fcمعادل یک سیگنال در همان باند با چگالی طیفی است اس، اگر میانگین توان آنها برابر باشد، یعنی. در واقع، برای یک سیگنال معمولی، فرمول آنتروپی در هر نمونه ثابت شد پیش از این، ما کدگذاری و انتقال اطلاعات از طریق یک کانال ارتباطی را در حالت ایده آل در نظر گرفتیم که فرآیند انتقال اطلاعات بدون خطا انجام شود. در واقع، این فرآیند ناگزیر با خطاها (تحریف) همراه است. کانال انتقالی که در آن اعوجاج امکان پذیر است نامیده می شود کانال پر سر و صدا

(یا سر و صدا). در یک مورد خاص، خطاها در طول خود رمزگذاری رخ می دهد و سپس رمزگذار را می توان به عنوان یک کانال نویز در نظر گرفت. وجود تداخل منجر به از دست رفتن اطلاعات می شود. برای به دست آوردن اطلاعات مورد نیاز در گیرنده در صورت وجود تداخل، باید اقدامات خاصی انجام شود. یکی از این اقدامات، وارد کردن به اصطلاح «اضافه» در پیامهای ارسالی است. در این مورد، منبع اطلاعات به وضوح بیش از آنچه در صورت عدم تداخل لازم است، نمادها را ارائه می دهد. یکی از اشکال معرفی افزونگی، تکرار ساده پیام است. این تکنیک، به عنوان مثال، با شنوایی ضعیف در تلفن، تکرار هر پیام دو بار استفاده می شود. یکی دیگر از راه های شناخته شده برای افزایش قابلیت اطمینان انتقال، انتقال کلمه "با حرف" است - زمانی که به جای هر حرف یک کلمه شناخته شده (نام) که با این حرف شروع می شود منتقل می شود. ظرفیت کانال زمانی که تعداد نمادهای ابتدایی بیش از دو باشد و زمانی که اعوجاج نمادهای منفرد وابسته هستند را می توان با استفاده از قضیه دوم شانون تعیین کرد. با دانستن ظرفیت کانال، می توان حد بالایی نرخ انتقال اطلاعات را در یک کانال نویز تعیین کرد. یک مثال را در نظر بگیرید: اجازه دهید یک منبع اطلاعات X وجود داشته باشد که آنتروپی آن در واحد زمان برابر است و یک کانال با پهنای باند X. سپس اگر پس با هر کدگذاری، انتقال پیام بدون تاخیر و تحریف غیرممکن است. سپس همیشه می توان یک پیام به اندازه کافی طولانی را رمزگذاری کرد تا بدون تاخیر و تحریف با احتمال خودسرانه نزدیک به یک ارسال شود. وظیفه 2: بررسی کنید که آیا پهنای باند کانال ها برای انتقال اطلاعات ارائه شده توسط منبع کافی است یا خیر، آیا منبع اطلاعاتی با آنتروپی در واحد زمان وجود دارد یا خیر. \u003d 110 (دو واحد)و تعداد کانال های ارتباطی n=2، هر یک از آنها می توانند در واحد زمان ارسال کنند K = 78کاراکترهای باینری (0 یا 1)؛ هر علامت دودویی با متضاد خود با احتمال جایگزین می شود μ=0.17. η(μ) = 0.434587 η(1 – μ) = 0.223118 η(μ) + η(1 - μ) = 0.434587 + 0.223118 = 0.657688 برای یک کاراکتر، اطلاعات 0.584239 (دو واحد) از بین می رود. ظرفیت کانال برابر است با: C \u003d 78 ∙ (1 - 0.657688) \u003d 26.7 ≈ 27 واحد باینری در واحد زمان. حداکثر مقدار اطلاعاتی که می توان از طریق دو کانال در واحد زمان منتقل کرد: 27∙2 = 54 (دو واحد)، که برای اطمینان از انتقال اطلاعات از منبع کافی نیست، زیرا منبع 110 int را ارسال می کند. واحدها در واحد زمان برای اطمینان از انتقال اطلاعات با حجم کافی و بدون تحریف، باید تعداد کانال های ارتباطی را تا سه کانال افزایش داد. سپس حداکثر مقدار اطلاعاتی که می تواند در سه کانال در واحد زمان منتقل شود: 3*54=162 واحد باینری در واحد زمان. 162>110، بنابراین، اطلاعات بدون تحریف منتقل می شود. برای انتقال اطلاعات بدون تاخیر، می توانید: 1. از روش رمزگشایی-رمزگشایی استفاده کنید. 2. اعمال companding سیگنال. 3. افزایش قدرت فرستنده. 4. از خطوط ارتباطی گران قیمت با محافظ موثر و تجهیزات کم سر و صدا برای کاهش تداخل استفاده کنید. 5. از فرستنده ها و تجهیزات میانی با سطح سر و صدای کم استفاده کنید. 6. برای رمزگذاری بیش از دو حالت استفاده کنید. 7. استفاده از سیستم های ارتباطی گسسته با استفاده از تمام بسته ها برای انتقال اطلاعات. ©2015-2019 سایت در هر سیستم ارتباطی، اطلاعات از طریق یک کانال منتقل می شود. نرخ انتقال آن نه تنها به خود کانال، بلکه به ویژگی های سیگنال اعمال شده به ورودی آن نیز بستگی دارد و بنابراین نمی تواند کانال را به عنوان وسیله ای برای انتقال اطلاعات مشخص کند. بیایید راهی برای ارزیابی توانایی کانال در انتقال اطلاعات پیدا کنیم. برای هر منبع، مقدار اطلاعاتی که از طریق کانال منتقل می شود، ارزش خاص خود را می گیرد. حداکثر مقدار اطلاعات ارسالی که از تمام منابع ممکن سیگنال ورودی گرفته شده است، خود کانال را مشخص می کند و پهنای باند کانال در هر نماد نامیده می شود: بیت / کاراکتر (که در آن بیشینه سازی روی همه توزیع های احتمال چند متغیره P(A) انجام می شود) همچنین امکان تعیین پهنای باند C کانال در واحد زمان وجود دارد. گذردهی یک کانال متقارن بدون حافظه را محاسبه کنید ارزش اولین مورد از این مقادیر با احتمال P و دومی با احتمال (1-P) رخ می دهد. همچنین از آنجایی که یک کانال بدون حافظه در نظر گرفته شده است، نتایج دریافت نمادها مستقل از یکدیگر است. بنابراین، H(B/A) به توزیع احتمال در گروه A بستگی ندارد، بلکه تنها با احتمالات انتقال کانال تعیین می شود. این خاصیت برای تمامی مدل های دارای نویز افزودنی حفظ می شود. با جایگزینی (2.27) به (2.26) دریافت می کنیم: از آنجایی که فقط عبارت H(B) در سمت راست به توزیع احتمال P(A) بستگی دارد، این عبارت است که باید حداکثر شود. حداکثر مقدار H(B) برابر با log m است و زمانی محقق می شود که همه نمادهای دریافتی به یک اندازه محتمل و مستقل از یکدیگر باشند. اگر نمادهای ورودی به یک اندازه محتمل و مستقل باشند، به راحتی می توان تأیید کرد که این شرط برآورده می شود، زیرا در این مورد در عین حال و از این رو توان عملیاتی در واحد زمان برای یک کانال متقارن باینری (m=2) توان عملیاتی بر حسب واحدهای دودویی در واحد زمان وابستگی به P طبق فرمول (2.31) با P=1/2، ظرفیت کانال باینری C=0 است، زیرا با چنین احتمال خطایی میتوان دنباله نمادهای باینری خروجی را بدون ارسال سیگنال از کانال، اما با انتخاب تصادفی آنها به دست آورد. به عنوان مثال، با توجه به نتایج پرتاب سکه، یعنی با P= 1/2 دنباله ها در خروجی و ورودی کانال مستقل هستند. حالت C=0 را شکست کانال می نامند. این واقعیت که توان عملیاتی در یک کانال باینری در P=1 برابر است با P=0 (کانال بدون نویز) با این واقعیت توضیح داده می شود که در P=1 کافی است تمام نمادهای خروجی معکوس شوند (یعنی 0 جایگزین شود). با 1 و 1 با 0 ) برای بازیابی صحیح سیگنال ورودی. توان عملیاتی یک کانال پیوسته به روشی مشابه محاسبه می شود. به عنوان مثال، اجازه دهید کانال دارای پهنای باند محدودی از عرض F باشد. سپس سیگنالهای U(t) و Z(t) به ترتیب در ورودی و خروجی کانال مطابق قضیه هستند. Kotelnikov با نمونه های آنها که از فاصله 1 / (2F) گرفته شده است تعیین می شود و بنابراین اطلاعاتی که برای مدتی T از کانال عبور می کند برابر با مجموع مقدار اطلاعات ارسال شده برای هر نمونه است. پهنای باند کانال به ازای هر یک از این نمونه ها: در اینجا U و Z متغیرهای تصادفی هستند - بخشهایی از فرآیندهای U(t) و Z(t) به ترتیب در ورودی و خروجی کانال، و ماکزیمم بر روی تمام سیگنال های ورودی مجاز، یعنی در تمام توزیع های U گرفته می شود. . خروجی C به عنوان مجموع مقادیر گرفته شده در تمام نمونه ها در هر ثانیه تعریف می شود. در این مورد، البته، آنتروپی های دیفرانسیل در (2.35) باید با در نظر گرفتن روابط احتمالی بین قرائت ها محاسبه شوند. اجازه دهید ظرفیت یک کانال پیوسته بدون حافظه با نویز گاوسی سفید افزودنی با پهنای باند عرض F را محاسبه کنیم، اگر میانگین توان سیگنال باشد. قدرت نویز (پراکندگی) در باند F با نشان داده می شود. قرائت سیگنال های خروجی و ورودی و همچنین نویز N با برابری مرتبط هستند: از آنجایی که N دارای توزیع نرمال با انتظار ریاضی صفر است، چگالی احتمال شرطی برای یک U ثابت نیز نرمال خواهد بود - با انتظار ریاضی U و واریانس. پهنای باند هر نمونه با فرمول (2.32) تعیین می شود: مطابق (2.24)، آنتروپی دیفرانسیل شرطی h(Z/U) توزیع نرمال به انتظارات ریاضی بستگی ندارد و برابر است. بنابراین، برای یافتن آن، باید چگالی توزیعی را یافت که در آن h(Z) حداکثر شود. از (2.33)، با در نظر گرفتن اینکه U و N متغیرهای تصادفی مستقل هستند، برای واریانس داریم بنابراین، واریانس ثابت است، زیرا و داده شده است. همانطور که مشخص است، با یک واریانس ثابت، حداکثر آنتروپی دیفرانسیل توسط توزیع نرمال ارائه می شود. از (2.33) می توان دریافت که با توزیع نرمال یک بعدی U، توزیع Z نیز نرمال خواهد بود و در نتیجه، حداکثر آنتروپی دیفرانسیل (2.24) تضمین می شود. با چرخش به گذردهی C در ثانیه، توجه میکنیم که اطلاعات ارسال شده روی چندین نمونه زمانی که نمونههای سیگنال مستقل هستند حداکثر است. این را می توان در صورتی به دست آورد که سیگنال U(t) طوری انتخاب شود که چگالی طیفی آن در باند F یکنواخت باشد. نمونه هایی که با فواصل مضرب 1/(2F) از هم جدا شده اند، به یکدیگر همبستگی ندارند و برای مقادیر گاوسی، همبسته به معنای مستقل است. . بنابراین، توان عملیاتی C (در هر ثانیه) را می توان با اضافه کردن توان عملیاتی (2.35) برای نمونه های مستقل 2F پیدا کرد: اگر U(t) یک فرآیند گاوسی با چگالی طیفی یکنواخت در باند فرکانس F (نویز شبه سفید) باشد، مشخص می شود. از (2.36) می توان دریافت که اگر قدرت سیگنال محدود نمی شد، آنگاه توان عملیاتی به طور دلخواه بزرگ خواهد بود. اگر نسبت سیگنال به نویز در کانال صفر باشد، توان عملیاتی صفر است. با افزایش این نسبت، به دلیل وابستگی لگاریتمی، توان عملیاتی به طور نامحدود، اما به کندی افزایش می یابد. رابطه (2.36) فرمول شانون نامیده می شود. این فرمول در تئوری اطلاعات مهم است، زیرا وابستگی توان عملیاتی کانال پیوسته در نظر گرفته شده را به مشخصات فنی آن مانند پهنای باند و نسبت سیگنال به نویز تعیین می کند. فرمول شانون امکان تبادل پهنای باند برای قدرت سیگنال و بالعکس را نشان می دهد. با این حال، از آنجایی که C به طور خطی به F و بر اساس - طبق قانون لگاریتمی بستگی دارد، معمولاً جبران کاهش احتمالی پهنای باند با افزایش قدرت سیگنال سودآور نیست. تبادل معکوس قدرت سیگنال برای پهنای باند کارآمدتر است. حداکثر مقدار اطلاعاتی که می تواند به طور متوسط در یک کانال پیوسته در زمان منتقل شود، برای یک کانال گاوسی توجه داشته باشید که وقتی Expression (2.37) با مشخصه ای به نام ظرفیت (حجم) کانال منطبق شود.

اگر شما نیاز به یافتن یک انتها (حداکثر، حداقل، یا نقطه زینی) از یک تابع از n متغیر f(x1، x2، …، xn) مرتبط با k دارید.

فرض کنید پیامی متشکل از n حرف وجود دارد: j=1، 2، …، n─ تعداد حروف در پیام به ترتیب، و i1، i2، ...، به اعداد.

حال فرض کنید که عناصر پیام (حروف) به یکدیگر وابسته هستند. در این حالت، احتمال وقوع یک دنباله از چند حرف برابر با حاصل ضرب احتمالات وقوع نیست.

همانطور که اشاره شد، آنتروپی در صورتی حداکثر است که احتمالات پیام ها یا نمادهایی که از آنها تشکیل شده اند یکسان باشد. چنین پیام هایی حاوی حداکثر اطلاعات ممکن است. اگر پیام دارد

معیار محتوا با cont (از انگلیسی Content ─ content) نشان داده می شود. محتوای رویداد I از طریق عملکرد اندازه گیری محتوای مربوط به آن بیان می شود

اگر اطلاعات در سیستم های مدیریتی استفاده می شود، منطقی است که سودمندی آن را با تأثیری که بر نتیجه مدیریت می گذارد، ارزیابی کنیم. در این راستا، در سال 1960، دانشمند شوروی A.A.

در اینجا آنتروپی تابعی از زمان در نظر گرفته می شود. در این مورد، هدف رهایی از عدم قطعیت است، یعنی. به موقعیتی دست یابید که آنتروپی برابر با 0 باشد. این وضعیت برای مشکلات معمولی است

داده های خام اغلب به صورت مقادیر پیوسته مانند دمای هوا یا آب دریا ارائه می شوند. بنابراین، اندازه گیری میزان اطلاعات موجود در چنین پیام هایی بسیار جالب است.

متغیر تصادفی a با بازه محدود می شود. در این حالت، انتگرال قطعی چگالی توزیع احتمال آن (قانون توزیع احتمال دیفرانسیل) بر روی

حال فرض می کنیم دامنه تعریف مقادیر یک متغیر تصادفی محدود نیست، بلکه واریانس آن D و انتظار ریاضی M داده شده است. توجه داشته باشید که واریانس با آن نسبت مستقیم دارد.

سیگنال های پیوسته - حامل های اطلاعات - توابع پیوسته یک آرگومان پیوسته - زمان هستند. انتقال چنین سیگنال هایی را می توان با استفاده از کانال های ارتباطی مداوم انجام داد.

ساده ترین و پرکاربردترین انواع کوانتیزاسیون عبارتند از: · کوانتیزه کردن بر اساس سطح (به سادگی می گوییم کوانتیزاسیون). کوانتیزاسیون زمان (ما تماس خواهیم گرفت

در نتیجه تبدیل معکوس از یک فرم پیوسته گسسته به یک پیوسته، سیگنالی به دست می آید که با مقدار خطای اصلی تفاوت دارد. سیگنال را تابع بازتولید می نامند

تئوری طیفی تعمیم یافته سیگنال ها روش های توصیف ریاضی سیگنال ها و نویز را ترکیب می کند. این روش ها امکان فراهم کردن افزونگی مورد نیاز سیگنال ها را به منظور کاهش اثر تداخل فراهم می کند.

یک طرح ممکن برای کوانتیزاسیون-انتقال-بازیابی سیگنال پیوسته را می توان همانطور که در شکل نشان داده شده است نشان داد. 2.5. برنج. 2.5. طرح کوانتیزاسیون-انتقال- احتمالی

در نتیجه کمی سازی زمانی تابع x(t)، یک سری مقادیر x(t1)، x(t2)، ... از کمیت کوانتیزه شده x(t) در زمان های گسسته t بدست می آید.

تابع بازتولید در بیشتر موارد با فرمول محاسبه می شود: ، جایی که برخی از توابع هستند. این ویژگی ها معمولا تمایل به انتخاب به طوری که. (2.14) در این مورد،

خطای درون یابی را پیدا کنید. بیایید آن را به صورت: , (2.16) نشان دهیم که در آن K(t) یک تابع کمکی است که پیدا می شود. برای t* دلخواه ما داریم: (

درون یابی توسط چند جمله ای های مرتبه n مشابه موارد قبلی در نظر گرفته می شود. در این حالت عارضه قابل توجهی از فرمول ها مشاهده می شود. تعمیم به فرمولی به شکل زیر منجر می شود:

مورد گسسته سازی یک فرآیند ارگودیک ثابت تصادفی x(t) با یک تابع همبستگی شناخته شده را در نظر بگیرید. ما با استفاده از چند جمله ای های لاگرانژ بازیابی می کنیم. اغلب اوقات

شکل 2.13 اصل کوانتیزاسیون سطح را نشان می دهد. برنج. 2.13. کوانتیزاسیون سطح این کوانتیزاسیون به جایگزینی مقدار سیگنال سطح اصلی کاهش می یابد

برنج. 2.19. علامت گذاری اجازه دهید اکنون تعداد مراحل کوانتیزاسیون n، مرزهای بازه (xmin, xmax) را تنظیم کنیم.

رمزگذاری عملیات شناسایی کاراکترها یا گروههایی از کاراکترهای یک کد با کاراکترها یا گروههایی از کاراکترهای یک کد دیگر است. رمز (رمز فرانسوی)، مجموعه ای از دانش

برخی از خصوصیات کلی کدها بیایید به نمونه هایی نگاه کنیم. اجازه دهید فرض کنیم که یک منبع گسسته بدون حافظه، به عنوان مثال. دادن پیام های مستقل - حروف - در خروجی، داشتن

قضیه 1. اگر اعداد صحیح n1، n2، ...، nk نابرابری (3.1) را برآورده کنند، یک کد پیشوند با الفبای اندازه m وجود دارد،

فرمولاسیون. اجازه دهید یک کد با طول کلمات رمز n1، n2، ...، nk و با الفبای حجم m داده شود. اگر کد به طور منحصر به فرد قابل رمزگشایی باشد، نابرابری کرافت برآورده می شود

فرمولاسیون. با توجه به آنتروپی H منبع و حجم m الفبای ثانویه، یک کد پیشوندی با حداقل میانگین طول nav min وجود دارد.

اجازه دهید اکنون موردی را در نظر بگیریم که نه حروف منبع منفرد، بلکه دنبالهای از حروف L را رمزگذاری میکنیم. قضیه 4. بیانیه. برای یک منبع گسسته معین

تعاریف کدهای ناهموار، کدهایی هستند که طول کلمات کد آنها متفاوت است. بسته به اینکه بهینه بودن را می توان به روش های مختلفی درک کرد

فرمولاسیون. برای هر منبعی با k>=2 حرف، یک کد باینری بهینه (به معنای حداقل میانگین طول کلمه رمز) وجود دارد که در آن دو لایه حداقل احتمال وجود دارد.

فرمولاسیون. اگر کد پیشوندی از گروه کاهش یافته U" بهینه باشد، پس کد پیشوند مربوط به گروه اصلی m

1. به حرف الفبای اولیه با کمترین احتمال وقوع، کد با بیشترین طول اختصاص داده می شود (لم 1)، یعنی. چنین کدی غیر یکنواخت است (با طول های مختلف کلمات رمز). در ر

همانطور که از نام آن پیداست، چنین کدگذاری برای از بین بردن اثرات مضر تداخل در کانال های انتقال اطلاعات طراحی شده است. قبلاً گزارش شده است که چنین انتقالی هم در فضا و هم در فضا امکان پذیر است.

خاصیت کدهای تصحیح خطا برای شناسایی و تصحیح خطاها به شدت به ویژگی های تداخل و کانال انتقال اطلاعات بستگی دارد. نظریه اطلاعات معمولاً دو ساده را در نظر می گیرد

فرض کنید کلمه رمز از n نماد باینری تشکیل شده است. احتمال عدم تحریف کلمه رمز همانطور که به راحتی قابل اثبات است برابر است با: . احتمال تحریف یک کاراکتر (تک

برای سادگی، کد بلوک را در نظر بگیرید. با کمک آن، به هر k بیت (حروف) دنباله ورودی یک کلمه کد n بیتی اختصاص داده می شود. تعداد از انواع مختلف

همینگ کران Q حداکثر تعداد ممکن کلمات کد مجاز یک کد یکنواخت را برای یک کلمه کد داده شده به طول n و توانایی اصلاحی کد CSC را تعیین می کند.

یکی از ویژگی های یک کد افزونگی آن است. افزایش در افزونگی، در اصل، نامطلوب است، زیرا حجم داده های ذخیره شده و ارسال شده را افزایش می دهد، با این حال، برای مبارزه با اعوجاج، بیش از حد

دسته ای از کدهای جبری به نام خطی را در نظر بگیرید. تعریف: کدهای خطی را کدهای بلوکی می گویند که ارقام اضافی آن تشکیل می شود

برای تعیین تعداد ارقام اضافی، می توانید از فرمول مرز همینگ استفاده کنید: . در این مورد، می توان یک کد فشرده به دست آورد، یعنی. کد با حداقل برای جفت های داده شده

کدهای خطی دارای ویژگی زیر هستند: از مجموع مجموعه 2k کلمه رمز مجاز که اتفاقاً یک گروه را تشکیل می دهند، می توان زیر مجموعه هایی از k کلمه را انتخاب کرد که دارای

روش فوق برای ساخت یک کد خطی دارای معایبی است. مبهم است (MDS را می توان به روش های مختلف مشخص کرد) و در اجرا در قالب دستگاه های فنی ناخوشایند است. این کاستی ها

تمام خواص کدهای حلقوی توسط یک چند جمله ای مولد تعیین می شود. 1. یک کد چرخه ای که چند جمله ای تشکیل دهنده آن حاوی بیش از یک جمله است، تمام خطاهای منفرد را تشخیص می دهد.

یک روش ساده برای ساخت یک کد با یک توانایی اصلاحی معین وجود دارد. این شامل موارد زیر است: 1. با توجه به اندازه داده شده از جزء اطلاعاتی یک کلمه رمز با طول

کدهای چرخه ای، مانند هر کد خطی، را می توان با استفاده از ماتریس توصیف کرد. به یاد بیاورید که KC(X) = gm(X)*U(X) . مثال ترتیب ضرب را نیز به یاد بیاورید

واضح است که چند جمله ای های کلمه رمز KS(X) باید بر چند جمله ای مولد g(X) بدون باقیمانده بخش پذیر باشند. کدهای چرخه ای متعلق به کلاس کدهای خطی هستند. این بدان معنی است که برای این کدها وجود دارد

کانال هایی را در نظر بگیرید که در نوع خطوط ارتباطی استفاده شده در آنها متفاوت هستند. 1. مکانیکی که در آن از حرکت هر جامد و مایع برای انتقال اطلاعات استفاده می شود

اکنون توان عملیاتی یک کانال ارتباطی گسسته با نویز را بررسی می کنیم. تعداد زیادی مدل ریاضی از این کانال ها وجود دارد. ساده ترین آنها یک کانال مستقل است

ما دنباله ای از حروف مستقل آماری را در نظر خواهیم گرفت. با توجه به قانون اعداد بزرگ، محتمل ترین دنباله هایی با طول n هستند که در آن، برای عدد N

فرمولبندی برای یک کانال مجزا در نویز، چنین روش کدگذاری وجود دارد که میتواند از انتقال بدون خطا همه اطلاعاتی که از منبع میآیند اطمینان حاصل کند.

قضیه شانون برای یک کانال پر سر و صدا، روش کدگذاری خاصی را نشان نمی دهد که انتقال مطمئن اطلاعات را با سرعت دلخواه نزدیک به ظرفیت کانال تضمین کند.

مدل کانال زیر را در نظر بگیرید: 1. کانال قادر به انتقال نوسانات با فرکانس های زیر Fm است. 2. تداخل n(t) در کانال وجود دارد که دارای (gau

هنگام وارد کردن یک فایل متنی ذخیره شده قبلی، نوع فایل *.* را مشخص کنید. این به شما این امکان را می دهد که تمام فایل های موجود در لیست را در حین انتخاب مشاهده کنید. فایل خود را مشخص کنید پس از آن، پنجره M روی صفحه نمایش داده می شود.

همانطور که در مقدمه نظری توضیح داده شد، میانگین آنتروپی با استفاده از فرمول های 1 و 2 به دست می آید. در هر دو مورد، شما باید احتمال وقوع حروف یا ترکیبات دو حرفی را پیدا کنید.

نتایج محاسبات را به صورت جدول ارائه دهید:<Язык 1>

<Язык

کنترل برنامه ای برنامه هایی که بخشی از مایکروسافت آفیس هستند با استفاده از به اصطلاح ماکروها انجام می شود. کلمه ماکرو ریشه یونانی دارد. ترجمه

قبل از ایجاد توابع سفارشی، باید فایل را در یک کتاب کار باز کنید که حاوی اطلاعاتی است که میخواهید با استفاده از این توابع سفارشی پردازش کنید. اگر این کتاب کار قبلا بود

ضبط با فشار دادن دکمه ضبط (شکل 5) که با دایره قرمز مشخص شده است شروع و پایان می یابد. در طول فرآیند ضبط، دکمه Record فشرده و سبک تر به نظر می رسد (هایلایت شده).

برای باز کردن یک فایل متنی با داده های صادر شده از برنامه Wavosaur دوبار کلیک کنید (شکل 23). برنج. 23. نمای تقریبی داده ها مشاهده می شود که صادر شده است

کوانتیزاسیون سطح شرط لازم برای تبدیل سیگنال پیوسته به شکل دیجیتال است. با این حال، کوانتیزاسیون سطح به تنهایی برای این کار کافی نیست - برای تبدیل به فرم دیجیتال

این الگوریتم برای ساختن رویه ساخت یک کد بهینه استفاده می شود که در سال 1952 توسط دکتر انستیتوی فناوری ماساچوست (ایالات متحده آمریکا) دیوید هافمن پیشنهاد شد: 5) حرف اول

الفبای هشت حرفی را در نظر بگیرید. واضح است که در رمزگذاری متعارف (غیر آماری) هر حرف برای نشان دادن به سه کاراکتر نیاز دارد. بزرگترین اثر

2 پارامتر وجود دارد: ضریب فشرده سازی آماری و ضریب بازده نسبی. هر دو پارامتر درجه کاهش میانگین طول کلمه کد را مشخص می کنند. در حالی که طول متوسط

5. به حرف الفبای اولیه با کمترین احتمال وقوع، کد با بیشترین طول اختصاص داده می شود (لم 1)، یعنی. چنین کدی غیر یکنواخت است (با طول های مختلف کلمات رمز). در ر

کار آزمایشگاهی شماره 4 تحت کنترل یک برنامه کنترل ویژه نوشته شده انجام می شود. این برنامه کنترلی در ویژوال بیسیک 6 نوشته شده است. فایل اجرایی برنامه حامل و

کدهای خطی دارای ویژگی زیر هستند: از کل مجموعه 2k کلمه رمز مجاز، زیر مجموعه هایی از k کلمه را می توان انتخاب کرد که دارای خاصیت استقلال خطی هستند.

کلمه رمز CS با ضرب ماتریس توالی اطلاعات ||X|| به دست می آید به ماتریس مولد ||OM||: ||KC1*n|| = ||X

در نتیجه انتقال یک کلمه رمز از طریق یک کانال، می تواند توسط تداخل تحریف شود. این باعث می شود که کلمه رمز دریافت شده ||PCS|| ممکن است با اصلی ||COP|| مطابقت نداشته باشد.

کار آزمایشگاهی شماره 5 مانند کار شماره 4 تحت کنترل یک برنامه کنترلی نوشته شده با زبان الگوریتمی ویژوال بیسیک 6 انجام می شود. فایل اجرایی برنامه به نام تداخل است.![]()

![]() به سرعت انتقال اطلاعات از طریق کانال ارتباطی گفته می شود. این مقدار برابر با مقدار اطلاعات نسبی ارسال شده در واحد زمان است. برای یک واحد زمان با یک کانال ارتباطی گسسته، در نظر گرفتن زمان انتقال یک کاراکتر راحت است. در این حالت، فرمول های نرخ انتقال اطلاعات، آنتروپی و مقدار اطلاعات در هر نماد را درک می کنند. برای کانال های ارتباطی پیوسته، از دو واحد اندازه گیری یا یک واحد مشترک (به عنوان مثال، یک ثانیه) یا یک فاصله زمانی بین نمونه ها استفاده می شود.

به سرعت انتقال اطلاعات از طریق کانال ارتباطی گفته می شود. این مقدار برابر با مقدار اطلاعات نسبی ارسال شده در واحد زمان است. برای یک واحد زمان با یک کانال ارتباطی گسسته، در نظر گرفتن زمان انتقال یک کاراکتر راحت است. در این حالت، فرمول های نرخ انتقال اطلاعات، آنتروپی و مقدار اطلاعات در هر نماد را درک می کنند. برای کانال های ارتباطی پیوسته، از دو واحد اندازه گیری یا یک واحد مشترک (به عنوان مثال، یک ثانیه) یا یک فاصله زمانی بین نمونه ها استفاده می شود. ![]() ، در این مورد آخر، فرمول ها به معنای آنتروپی های دیفرانسیل در هر تعداد (یا درجه آزادی) هستند. اغلب، کتابچه های راهنما به طور خاص نشان نمی دهند که کدام یک از این دو واحد استفاده می شود. در این رابطه اغلب از فرمول دیگری برای میانگین نرخ انتقال اطلاعات استفاده می شود

، در این مورد آخر، فرمول ها به معنای آنتروپی های دیفرانسیل در هر تعداد (یا درجه آزادی) هستند. اغلب، کتابچه های راهنما به طور خاص نشان نمی دهند که کدام یک از این دو واحد استفاده می شود. در این رابطه اغلب از فرمول دیگری برای میانگین نرخ انتقال اطلاعات استفاده می شود![]()

![]()

![]()

![]()

![]()

تمامی حقوق متعلق به نویسندگان آنها می باشد. این سایت ادعای نویسندگی ندارد، اما استفاده رایگان را فراهم می کند.

تاریخ ایجاد صفحه: 1395/02/13مبحث 2.5. ظرفیت کانال ارتباطی

![]() (2.26)

(2.26) در این مورد، محاسبه آسان است، زیرا احتمال شرطی (انتقالی) تنها دو مقدار را می گیرد: اگر و (1-P)، اگر .

در این مورد، محاسبه آسان است، زیرا احتمال شرطی (انتقالی) تنها دو مقدار را می گیرد: اگر و (1-P)، اگر . (2.27)

(2.27)

![]() (2.34)

(2.34) (2.36)

(2.36) (2.37)

(2.37)